#ai #sztucznainteligencja #heheszki #gif #programowanie

#ai #sztucznainteligencja #heheszki #gif #programowanie

Zaloguj się aby komentować

Zaloguj się aby komentować

Zaloguj się aby komentować

W piątek przed Wydziałem Własności Intelektualnej Sądu Okręgowego w Warszawie rusza pierwszy w Polsce proces dotyczący bezprawnego komercyjnego wykorzystania głosu wygenerowanego przez sztuczną inteligencję. Sprawa dotyczy reklamy, w której użyto cyfrowego modelu głosu lektora Jarosława Łukomskiego...

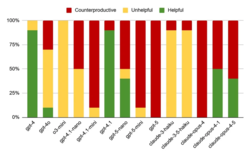

Asystenci kodowania AI, po okresie poprawy, wykazują teraz oznaki regresji, przy czym nowsze modele prezentują bardziej podstępne tryby awarii. Te zaawansowane modele często generują kod, który wydaje się działać poprawnie, ale zawiera ukryte błędy, co czyni je trudniejszymi do wykrycia i...

Jak już ciśniemy temat botów

Meta się w tańcu nie pi⁎⁎⁎⁎li i na swoich social mediach wprowadziła/dzała w zeszłym roku przełomowe rozwiązanie.

Z racji umierających Instagrama i Facebooka wprowadzili, czy też mieli wprowadzić, boty AI, które będą obcować z użytkownikami poprawiając ich widoczność, engagement i chuje muje dzikie węże.

Czyli: Po latach grzebania w algorytmie, który wywrócili na lewą stronę i sprawili, że użytkownicy takiego Instagrama nie docierają nawet do swoich obserwujących, a obserwujący nie widzą obserwowanych, więc jedni i drudzy przestają się udzielać na platformie, meta postanowiła temu zaradzić przy użyciu botów, które będą się udzielały zamiast ludzi, których przepędzili.

Czym przepędzą kolejnych

I kolejnych

Ale reklamodawcom mogą pokazać innowację i że się dzieje.

A my tu gadamy o jakichś śmiesznych "pustych kontach" na wykopie.

https://smk.co/metas-unleashing-an-army-of-ai-bots-to-boost-engagement/

https://www.clickguard.com/blog/ai-bots-on-meta/

#ai #sztucznainteligencja #socialmedia

Zaloguj się aby komentować

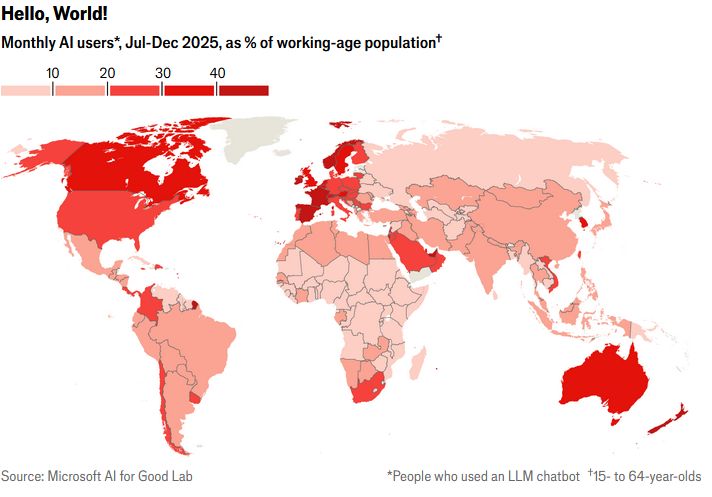

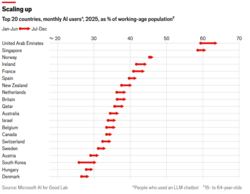

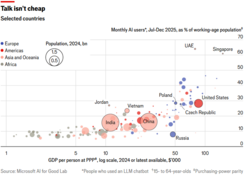

Jak wygląda używanie chatbotów w porównaniu międzynarodowym? Badanie Microsoftu

Microsoft oszacował dane na podstawie używania chatbotów na urządzeniach z systemem operacyjnym Windows (sorry linuksiarze). Badacze mieli te dane jakoś skorygować jeszcze przez wskaźniki używania telefonów komórkowych w danym kraju i pokazali dane jako procent ludności w wieku produkcyjnym,

Na pierwszym miejscu na świecie znalazły się Zjednoczone Emiraty Arabskie oraz Singapur (oba z wynikiem ponad 60%). Generalnie korelacja wysokich zarobków z częstotliwością używania chatbotów była zdecydowanie pozytywna (co jest widoczne na 3 grafice). Chociaż można się zastanawiać, na ile te wyniki są wiarygodne (kraje rozwijające się zdecydowanie częściej korzystają z telefonów do łączności z internetem, a do tych danych Microsoft dostępu nie miał), to pokazują przynajmniej mały wycinek światowego obrazka.

Źródełko: https://www.economist.com/graphic-detail/2026/01/12/which-countries-are-adopting-ai-the-fastest

#sztucznainteligencja #statystyki

#owcacontent

Zaloguj się aby komentować

#ai #sztucznainteligencja #heheszki #humorinformatykow

Co za debil. Serwery DNS nie mają w tablicy adresu IP zewnętrznego localhosta. Poprawny adres to http://127.0.0.1:3000 .

Zaloguj się aby komentować

Malezja zablokowała dostęp do chatbota Grok należącej do Elona Muska firmy xAI. Wokół narzędzia wybuchł skandal po tym, jak zaczął tworzyć pornograficzne deepfake'i z wizerunkami kobiet i dzieci. Komisja Łączności i Multimediów Malezji przekazała, że w kraju stwierdzono wielokrotne niewłaściwe...

Władze w Dżakarcie tymczasowo zablokowały w sobotę dostęp do chatbota Grok, stworzonego przez firmę xAI, należącą do miliardera Elona Muska. Indonezja jest pierwszym państwem na świecie, które zdecydowało się na ten krok w związku z ryzykiem generowania przez sztuczną inteligencję materiałów o...

Dlaczego ceny kości RAM są takie drogie? Odpowiedź na obrazku. #komputery #ai #it #sztucznainteligencja

Zaloguj się aby komentować

DeepSeek, czołowy chiński start-up sztucznej inteligencji, jest popularny w Białorusi, Rosji, Syrii, Iranie i Etiopii, wynika z nowego badania Microsoftu. Chińska sztuczna inteligencja (AI) DeepSeek zyskuje na znaczeniu w wielu krajach rozwijających się. Wyprzedza amerykańskie modele popularne na...

Pekin zwrócił się w tym tygodniu do niektórych chińskich firm technologicznych o wstrzymanie zamówień na układy scalone Nvidii i prawdopodobnie nakaże zakup krajowych układów sztucznej inteligencji - poinformował portal Information. Nvidia znalazła się w rozterce między Waszyngtonem a Pekinem,...

#hejtozabawa #kiciochpyta #sztucznainteligencja

Wymień w komentarzu trzy ostatnie użycia AI, nie ważne w jaki sposób.

Wygenerowanie Springowego klienta dla Dellowej macierzy PowerStore w celu zbudowania narzędzia do monitorowania i analizy zdarzeń na wielu urządzeniach w SANie.

Poprawienie błędów bo do modeli nie dociera, że PowerStore nie używa wprost formatu daty ISO8601.

Poprawienie błędów po poprawie błędów (ten krok był powtórzony kilka razy)

Pierdolnięcie tym całym AI i napisanie tych 15 klas ręcznie 3x szybciej niż zajęło wcześniej debugowanie

@RobertCalifornia Wtyczka Copilota do IntelliJ, modele GPT-4.1 oraz Claude Sonnet 4 (tu się pojawiają takie odpały, że trudno mi to opisać).

Istotnym jest by wspomnieć iż każdy task musi spełniać trzy podstawowe "wartości":

Reliability

Reliability

Reliability

więc wszystko jest testowane na pierdyliard różnych sposobów, przez co często wychodzą różne kwiatki.

Zaloguj się aby komentować

Co Wy na to? 07.01.2026

Usługi oparte na sztucznej inteligencji począwszy od opublikowania ChataGPT w listopadzie 2022 roku przeżywają prawdzimy boom. W chwili obecnej każde rozwiązanie technologiczne musi zawierać w sobie jakieś rozwiązanie na tym oparte. Aplikacje chatbotowe zdecydowanie pokonują inne aplikacje w kategorii zdobywania nowych użytkowników. Największe z nich są regularnie używane nawet przez kilkaset milionów użytkowników.

Z drugiej jednak strony coraz częściej dochodzą do głosu słowa krytyki wobec wszechobecnym wytworom chatbotów. Zdaniem redakcji The Economist czy internetowego słownika Merriam‑Webster ubiegłorocznym słowem roku stało się slop, oznaczające pomyje - jako że wytwory AI zaczynają błyskawicznie zapełniać internet treściami niskiej jakości. Z kolei Satya Nadella, prezes Microsoftu, zdecydowanie nie zgadza się z tym terminem.

Pytanie na dziś: Czy jestem zadowolony/a z ewolucji usług opartych na sztucznej inteligencji?

Zapraszam do oddawania głosów w ankiecie oraz kulturalnej dyskusji w komentarzach. Zastrzegam, że treści niezgodne z polskim prawem i obraźliwe wobec innych użytkowników będę usuwał niezależnie od poglądów.

#cowynato #ai #sztucznainteligencja #technologia #ankieta

#owcacontent

AI do analizy danych, wyciągania wniosków - jak najbardziej tak.

AI do rozwiązywania problemów typu: "coś mi nie działa w kompie" - tak, ale... już widać, że drastycznie spadła ilość zapytań do portali "specjalistycznych", bo GPT odpowie szybciej. Fakt, ale również spadła tam ilość nowej wiedzy. Powoli ci, którzy mają taką wiedzę zaczynają ją trzymać dla siebie, bo jak się pochwalą rozwiązaniem jakiegoś problemu, to LLM'y zassają to za minutę do siebie i już jesteś niepotrzebny.

AI jako zespół programistów? Nie.

Dlaczego? Bo to jest pętla śmierci.

Już widzę jak ludzie na LinkedIn podniecają się tym, że z Claude przez noc "napisali" jakąś tam aplikację. Super, nie? Ale po pierwsze jak coś przestanie działać, to nie mają pojęcia co i dlaczego - jeśli im AI nie pomoże, to nic nie zrobią.

Po drugie - pętla śmierci polega na tym, że taki Claude zastępuje głównie "juniorów". Na dziś w pracy pozostają "seniorzy", których jeszcze AI nie zastępuje. Tylko, że ci seniorzy za jakiś czas się wykruszą, pójdą na emerytury i kto ich zastąpi? Juniorów przecież nie ma, bo AI ich zastąpiła, prawda? Seniorów nie ma, bo nie ma juniorów, którzy się nauczyli na tyle, żeby ich zastąpić.

I mamy gotowy przepis na klęskę. Kto będzie pisać kod AI, skoro nie będzie już nowych specjalistów? AI? Oczywiście taki scenariusz jest możliwy, ale w paru książkach SF można przeczytać, że to nie jest dobry kierunek.

Będziemy mieli do czynienia z technologią, której nikt już nie rozumie, nie wie co zrobić, jak coś padnie, nie wie jak ją ulepszyć.

W razie problemów cofniemy się o wiele lat, bo trzeba będzie jakoś zrozumieć to AI, tylko czy będzie ktoś o odpowiedniej wiedzy? Przecież wszystkich specjalistów zastąpiła AI.

Nie podoba mi się ten hurra optymizm, że AI to zastąpi (tu wpisz dowolny zawód) - a co z tymi ludźmi? Utylizować, zagonić do rezerwatów? Przecież zastępowanie kolejnych zawodów przez AI, to jest powiększanie bezrobocia bez pomysłu co dalej.

To, co będzie produkować się przy pomocy AI, gdzieś komuś trzeba sprzedać, prawda? A jeśli będziesz miał coraz więcej bezrobotnych, to gdzie ten rynek zbytu?

Dojdziemy do jakiejś utopii z dochodem gwarantowanym, co czegoś w rodzaju świata z "Limes Inferior"? Czy bardziej z "Pompy numer 6"? Bo na świat ze "Star Treka" to raczej nie liczę.

@maly_ludek_lego Trzeba będzie chyba powrócić do idei gildii, ich tajemnic, ogólnie bardziej traktować wiedzę jak magię, bo dzielenie się wiedzą staje się po prostu frajerstwem i pompowaniem kasy w bigtechy.

Udzielasz się na jakichś grupach specjalistycznych? Za chwilę jakiś 'manago' może stwierdzić, że nie jesteś potrzebny bo AI wie to samo. Od ciebie to wie, ale ty już się pakujesz i opuszczasz stanowisko.

Można też zatruwać LLM'y pisząc jakieś bzdury, żeby się potem taki specjalista posługujący AI w pracy przewrócił na ten swój głupi ryj.

Dla mnie AI zabiło wszystkie społecznościowki. Jedyne gdzie zostałem i gdzie się udzielam to hejto I co nieco reddit, ale tylko co nieco. Reszta zamienila się w totalny szlam nie do czytania.

Dlatego uciekłem.

Może to i dobrze.

A poza tym, niestety ludzie łykają ruską i chińską propagandę pełnymi garściami.

Zaloguj się aby komentować

Sam Altman to twórca ChatGPT i jedna z najbardziej wpływowych osób w świecie AI. Wszyscy słyszeli o OpenAI, ale mało kto wie, jakie decyzje, kontrowersje i sprzeczności stoją za tą technologiczną rewolucją. W tym filmie pokazuję pełną historię Sama Altmana — od pierwszych startupów, przez kulisy...

adeptom #programowanie polecam myśleć o testach jednostkowych jako "zbiorze aksjomatów o kodzie których znajomości oczekujesz od próbujących rozwijać twój system".

dodatkowe twierdzenie do udowodnienia w swojej duszy dla chętnych - #sztucznainteligencja nie chce nic, więc większość testów jednostkowych które proponuje jest k⁎⁎wa bez sensu xD

#autyzm #psychiatria #komunikacja

prompt: zaproponuj wpis na portal społecznościowy hejto na temat "co to testy jednostkowe"

Pewnie każdy coś słyszał, ale krótko i po ludzku

Co to są testy jednostkowe?

Testy jednostkowe to małe, automatyczne sprawdziany dla kodu.

Biorą najmniejszy sensowny kawałek programu (funkcję, metodę, klasę) i sprawdzają, czy:

dla danych wejściowych X

zwraca wynik Y

zawsze i przewidywalnie

To trochę jak test smaku w kuchni:

zanim podasz danie gościom, próbujesz łyżeczką sosu, a nie czekasz aż ktoś się zatruje.

Po co to komu?

Czego testy jednostkowe NIE robią:

nie sprawdzają UI

nie testują całego systemu

nie zastępują myślenia

Najczęstszy błąd:

„Napiszę testy na końcu”

(spoiler: na końcu już się ich nie pisze)

Dobrze napisany test jednostkowy to:

szybki

deterministyczny

czytelny

testuje jedną rzecz

A najlepszy moment na testy?

Jeśli chcesz, w kolejnym wpisie mogę:

pokazać zły vs dobry test

albo wytłumaczyć testy bez frameworków i buzzwordów

@wombatDaiquiri

Biorą najmniejszy sensowny kawałek programu

To jest mega nieoczywiste. Moim zdaniem AI często testuje zbyt nisko, betonując kod.

To jest mega artykuł na ten temat - w Pythonie, ale imo lang agnostic. Cała książka też sztos.

https://www.cosmicpython.com/book/chapter_05_high_gear_low_gear.html

Generalnie narzucanie architektury dla kodziku to jedna z ważniejszych rzeczy przy vibe-codowaniu.

Ja ogólnie lubię TDD i wydaje mi się, że to najlepszy sposób na AI. Odpalasz takiego gemini cli i mowisz aby na podstawie wymagań (tutaj uzupelniasz) napisał Ci testy. Sprawdzasz czy mają sens i potem w kolejnej iteracji mówisz aby zaimplementował kod jtóry przejdzie testy i spełni wymagania. Potem każda poprawka to najpierw poprawa testów, a dopiero potem zmiany w kodzie. Takie coś u mnie się sprawdza

@dotevo

mowisz aby na podstawie wymagań (tutaj uzupelniasz)

Czyli dosłownie przekazujesz logikę testów a AI je tylko tłumaczy na język programowania? Czy w ogóle piszesz test i mówisz „uzupełnij przykłady dla następujących warunków brzegowych”? Pragnę zwrócić jedynie Twoją uwagę na fakt, ze całe „myslenie” tj. „podejmowanie decyzji na podstawie ekspertyzy” nadal w swoim podejściu odpowiadasz sam.

@wombatDaiquiri ależ oczywiście. Zresztą osobiście mało używam AI w pracy. Za to do hobbistycznych projektów owszem bo mocno przyśpiesza pracę, a przy tym trenuję sobie jak pracować z AI.

Wydaje mi się, że dałoby radę napisać jednego dobrego prompta, który zrobi wszystko. Używam gemini-cli i piszę mu tylko "W pliku readme.md masz opis projektu, zaimplementuj go używając TDD w języku XYZ. Projekt będzie gotowy gdy ...., pamiętaj o podziale na moduły oraz kod musi być w języku angielskim". Potem mieli cały dzień i na koniec wychodzi coś sensownego. W prompcie najlepiej wprost powiedzieć na co musi zwrócić uwagę. Np. bezpieczeństwo, testy e2e, dokumentację itd.

Druga sprawa to czego używasz do kodowania? bo wg mnie chatgpt jest słaby, gemini ok, claude najlepszy - ale za free mało można.

@wombatDaiquiri Mój problem z UT (po nastu latach pracy w zawodzie) jest taki, że są to duplikaty większości aksjomatów które w kodzie... już są. W kodzie.

Kod produkcyjny jest sam w sobie właśnie takim aksjomatem. Więc dodanie duplikatu powoduje w wielu (nie wszystkich!) wypadkach marnowanie czasu na pracę "żeby testy przeszły" po najmniejszej zmianie: czy to funkcjonalnej, czy refaktorze.

Dlatego z mojej perspektywy podwójnie chore są "progi pokrycia testami jednostkowymi" które spotykam w różnych firmach.

Gdyby tylko zamiast nad testami UT spędzić więcej czasu nad kodem produkcyjnym, przygotowaniem zmian... : ).

UT nie są zupełnie bezużyteczne. Nie wszystko da się łatwo wyczytać z kodu, wyłączam z tego zbioru UT na bardzo nietypowe edge case'y (typu reprodukcje bugów) i testy modułowe (które de facto nie są UT, ale to często te same narzędzia i ten sam run).

@baklazan ja osobiście potrzebuje „sanity check” ze każdy komponent który napisałem działa tak jak sie spodziewam zanim będę składał komponenty ze sobą. Ale ja pracuję też dość głęboko w infrastrukturze dużych serwisów, więc mogę mieć zboczenie na bezawaryjność.

Natomiast zazdroszczę ludziom którzy są przekonani ze napisali to co chcieli po tym jak to napiszą xD

@wombatDaiquiri Nigdy nie jesteś pewien na 100%, więc testy są konieczne: po prostu z reguły UT są najmniej użyteczne. Generalnie chodzi o to żeby tworzyć zmiany małymi krokami, używając do tego bardzo małych commitów, jednocześnie nie zmieniając zachowania tam gdzie nie trzeba.

Podam Ci przykład jak do tego podchodzę:

Zmiana w aplikacji rozszerzającej zachowanie jakiegoś modułu.

Zaczynasz od refactorów, które mają nie zmieniać zachowania klasy. Każdy refactor to osobny commit. Każdy commit musi być czysty (tzn nie zawierać innych zmian, nie będących częścią tego co robisz), więc np:

- osobny commit na uporządkowanie zmiennych w funkcji, tak, żeby dało się jej część wyciągnąć robiąc niewiele więcej niż kopiuj-wklej,

- osobny commit na wydzielenie metody,

- itd.

Generalnie osobny commit na każdy krok refactoringowy. Podobnie przy dodawaniu nowego kodu, idealnie byłoby podzielić go na kawałki.

Każdy commit musi działać! (przechodzić wszystkie testy itp)

Z reguły zmiany wprowadzające zmianę zachowania są na końcu takiego brancha/patchsetu i powinny być tryawialne: żebyś był w stanie szybko je wycofać, ale też szybko wyłapać jakiś problem.

Wiadomo - przeoczysz wiele błędów. Ale jeśli przy każdym commicie przejrzysz zmiany które zrobiłeś, zmniejszasz szansę na wprowadzenie regresji, i to wielokrotnie. Pomaga przy tym pisanie dobrych opisów commitów: opisując nie "co zrobiłem" tylko "po co to zrobiłem" - to "co zrobiłeś" widać w commicie, zwłaszcza jeśli jest mały i prosty. Pytanie "dlaczego ten commit zrobiłeś" jest jeśli nie nieoczywiste to na pewno trudne do zgadnięcia. Finalnie: odpowiedź na to pytanie wiele razy sprawiła że wywaliłem dane zmiany jako kompletnie niepowiązane ; D.

To jest workflow do którego się trzeba przyzwyczaić, wymaga dużo czytania i rozumienia kodu, ale bardzo szybko powoduje, że nie dość że robię o wiele mniej błędów, to do tego bardzo dobrze rozumiem co się dzieje w kodzie - żeby przygotować dobry patchset musisz dobrze zrozumieć co robi kod w którym pracujesz.

Prywatnie zmieniło to moje podejście do pisania kodu o 180 stopni. Jeśli zaczniesz stosować ten workflow i nabierzesz wprawy zaczynasz pisać kod paradoksalnie bardzo szybko i bez błędów - nie marnuję czasu na debugowanie, bo najczęściej nie mam po co go robić.

I powoduje że UT są po prostu upierdliwe, bo przenoszę ciężar z "napisz kod produkcyjny i opisz go testami" na "napisz kod produkcyjny tak żeby działał i nic nie popsuł". Testuję go najczęściej tylko manualnie wysokopoziomowo, czasem piszę i odpalam testy modułowe/systemowe.

Zaloguj się aby komentować

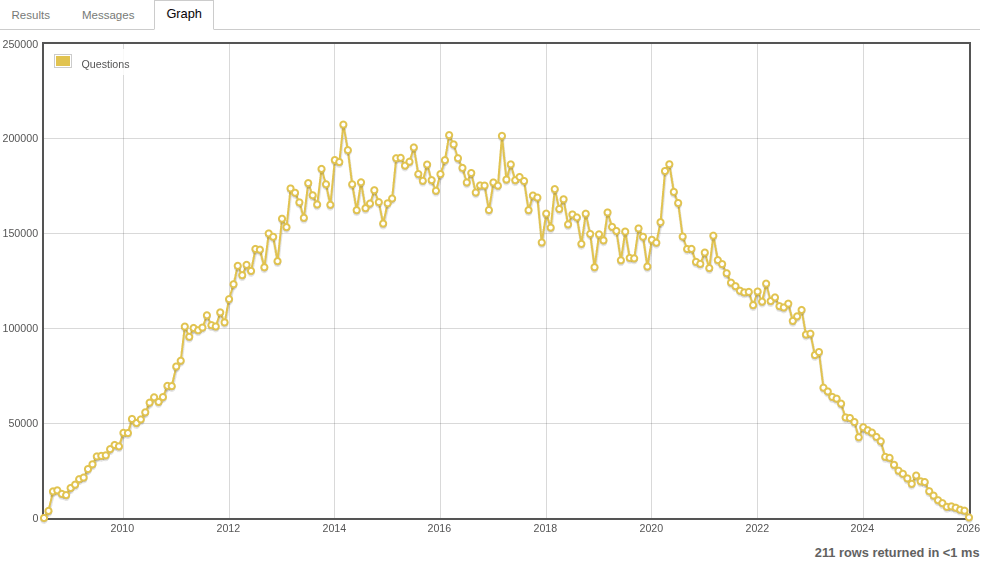

Wykres przedstawia całkowitą liczbę pytań zadanych na Stack Overflow każdego miesiąca, pokazując znaczący spadek związany z pojawieniem się narzędzi #ai. Sugeruje to, że złota era niezależnych serwisów informacyjnych, blogów, forów i witryn takich jak Stack Overflow dobiegła końca.

Niezależne strony nie mogą konkurować z korporacjami będącymi ponad prawem dysponującymi nieograniczonymi funduszami. Nawet Wikipedia odnotowała spadek ruchu z Google z powodu tych zmian. Aplikacje AI nie przypisują zasług ani nie kierują użytkowników z powrotem do oryginalnych źródeł. W rezultacie ludzie przestają tworzyć nowe treści lub edytować istniejące.

Wygląda na to, że patrzymy właśnie na ostatnie chwile Internetu, jaki znamy.

#sztucznainteligencja #ainews #ciekawostki #internet

@inty Od lat Google coraz szybciej mutuje ze sprawnej wyszukiwarki pełnej nerdowskich sztuczek z site:, frazami w cudzysłowie i tak dalej, w jakiegoś korpopotwora, mieszankę spamerskiego słupa ogłoszeniowego, sklepiku z barachłem i losowo wrzucanego nawozu, mającego luźny albo i żaden związek z wpisaną frazą. Wciskany na samą górę wyników "przegląd od AI" paradoksalnie trochę tu ułatwił, bo odpowiedź lepsza lub gorsza jest zaraz na początku i nie trzeba już przekopywać tej sterty bezużytecznego nawozu poniżej.

No i jest jeszcze Bing. Bing ma swój świat i czasami sprawia wrażenie, jakby w ogóle nie rozumiał o co pytasz. Microsoft i tak to za jakiś czas wygasi jak większość swoich projektów skierowanych do przeciętnego śmiertelnika.

@Klockobar to bardzo powierzchowne wnioski, stagnację i lekki spadek widać na tym wykresie wyraźnie od 10 lat. Stack overflow nie miał pomysłu na siebie. Wszyscy mieli kija w d⁎⁎ie, mentalność elektrody a ejaje tylko przyspieszyły upadek. No i druga kwestia, że na stacku jest tak, że jak ktoś szuka pytania a podobne już istnieje to nie postujesz drugiego jeśli w znalezionym znalazłeś odpowiedź. A wykres ilustruje tylko nowe dodane pytania.

@nbzwdsdzbcps Wyobrażam sobie to tak, że potężny zespół Hindusów będzie karmił AI o nowe wydarzenia ze świata itd. Jeżeli chodzi o np. samo programowanie, to rozwój się powoli zatrzymuje w temacie nowych technologii. Więc tutaj nie będzie już chyba niczym karmiona. Tutaj fajny artykuł na ten temat.

Zaloguj się aby komentować