Nie ma to jak uzywac ej aj do podsumowania wideło o oszczędnościach w pracy z ej aj XD:

(nie probowalem ale wrzucam moze komus sie przyda)

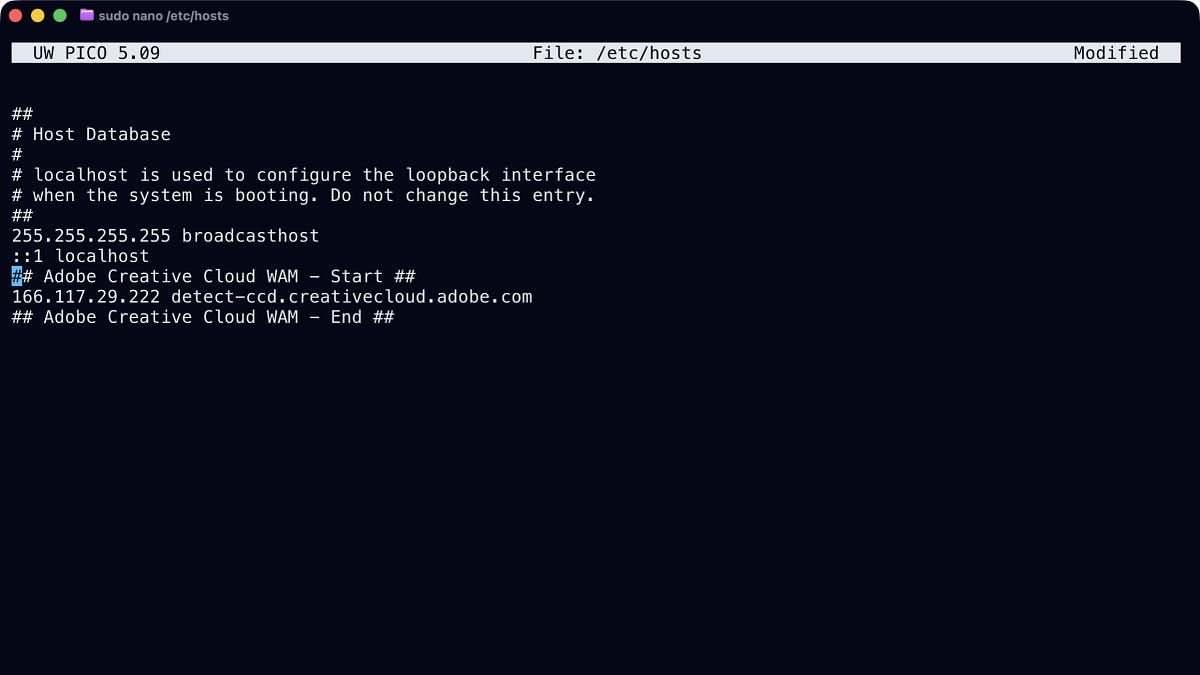

Optymalizacja pracy z Claude Code, aby uniknąć przekraczania limitów użycia:

Głównym problemem jest tzw. "Context Compound" – każda nowa wiadomość przesyła ponownie całą historię rozmowy, co szybko zużywa tokeny i może prowadzić do spadku precyzji modelu ("Context Rot").

Kluczowe strategie optymalizacji:

-

Zarządzanie narzędziami MCP (Model Context Protocol):

-

Leniwe ładowanie (Lazy Loading): Włączenie zmiennej środowiskowej ENABLE_TOOL_SEARCH sprawia, że Claude ładuje definicje narzędzi tylko wtedy, gdy są potrzebne, zamiast ładować wszystko na starcie (co może oszczędzić 20-100 tys. tokenów).

-

Zamiana MCP na CLI: Wiele narzędzi (np. Supabase, Sentry, Jira, Vercel) lepiej obsługiwać przez interfejs wiersza poleceń (CLI). Wywołania CLI zużywają znacznie mniej tokenów niż ich odpowiedniki MCP.

-

-

Optymalizacja "Umiejętności" (Skills) i Promptu Systemowego:

-

Audyt umiejętności: Usuwanie przestarzałych lub dublujących się skryptów/umiejętności zainstalowanych w Claude Code.

-

Odchudzanie CLAUDE.md : Przenoszenie szczegółowych instrukcji z głównego pliku promptu systemowego do osobnych plików referencyjnych w folderze dokumentacji. Claude będzie po nie sięgał tylko w razie potrzeby.

-

-

Zmiany w ustawieniach konfiguracyjnych (settings.json):

-

Wcześniejsze autokompaktowanie: Zmiana progu auto_compact_percentage_override (np. z domyślnych 83% na 50-75%), aby model streszczał kontekst zanim zacznie tracić na dokładności.

-

Zwiększenie limitu wyjścia Bash: Ustawienie wyższego limitu BASH_MAX_OUTPUT_LENGTH zapobiega ucinaniu wyników komend, co eliminuje kosztowne (w tokenach) ponowne próby ich uruchamiania przez model.

-

Reguły odmowy dostępu (Deny Rules): Podobnie jak w .gitignore, warto zdefiniować foldery, których Claude nie powinien czytać (np. node_modules, dist, cache), aby niepotrzebnie nie zapychały kontekstu.

-

Wprowadzenie tych zmian pozwala na zmniejszenie początkowego zużycia kontekstu o kilkadziesiąt procent, co przekłada się na dłuższą i bardziej efektywną pracę bez uderzania w limity.

#ai #it

![Nicholas Carlini - Black-hat LLMs | [un]prompted 2026](https://cdn.hejto.pl/uploads/posts/images/250x250/65350b2511bfb084c864913d1e89f41a.jpg)