Już niebawem, 1 kwietnia, będziemy obchodzić 25 rocznicę powstania marki Radeon.

AMD świętuje 25-lecie kart graficznych marki Radeon, której korzenie sięgają jeszcze czasów firmy ATI. Radeon wielokrotnie rywalizował, a nawet wygrywał w starciach z konkurencją. Choć w ostatnich latach karty te pozostawały w cieniu NVIDII, jednak dzięki architekturze RDNA 4 i nadchodzącej UDNA sytuacja może się ponownie odmienić.

Wracając jednak na chwilę do firmy ATI - ta została przejęta przez AMD w 2006 roku, a Radeon pozostał kluczową marką w świecie kart graficznych. W kolejnych latach AMD kontynuowało jej rozwój, wprowadzając przełomowe modele, takie jak Radeon HD 4000 i HD 5000, które jako jedne z pierwszych wspierały DirectX 11. Następnie przyszły serie Radeon R9 200 oraz RX 400 i RX 500, które umocniły pozycję firmy w segmencie graczy szukających wydajnych, ale przystępnych cenowo rozwiązań. Przez lata Radeon rywalizował z NVIDIA, niejednokrotnie oferując świetny stosunek ceny do wydajności. Jednak w ostatniej dekadzie dominacja konkurenta stała się bardziej wyraźna. Teraz, wraz z premierą RDNA 4 i zapowiedziami nadchodzącej architektury UDNA, AMD ponownie wkracza do gry, próbując odwrócić ten trend.

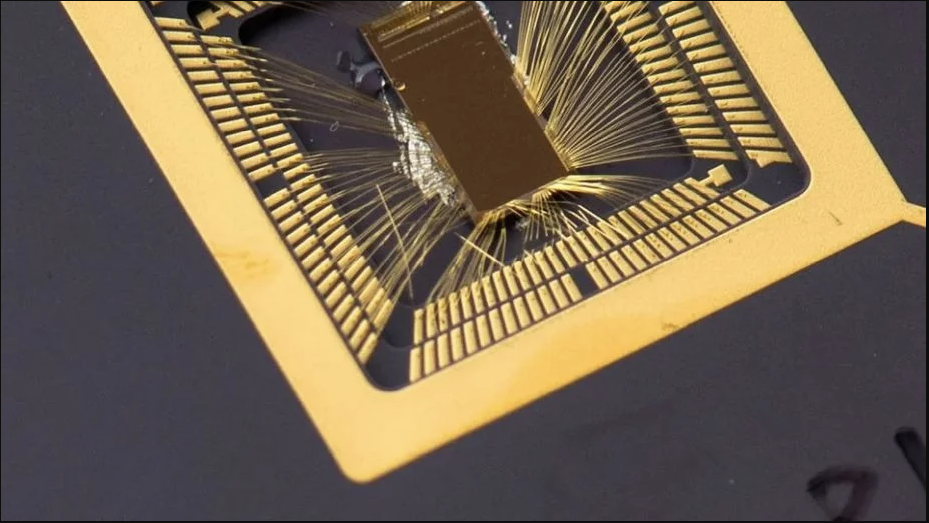

Pierwszą kartą graficzną był:

Radeon R100 is the first generation of Radeon graphics chips from ATI Technologies. The line features 3D acceleration based upon Direct3D 7.0 and OpenGL 1.3, and all but the entry-level versions offloading host geometry calculations to a hardware transform and lighting (T&L) engine, a major improvement in features and performance compared to the preceding Rage design. The processors also include 2D GUI acceleration, video acceleration, and multiple display outputs. "R100" refers to the development codename of the initially released GPU of the generation, various releases which were collectively known as the Radeon 7200. It is the basis for a variety of other succeeding products, including the entry-level RV100 (Radeon VE or Radeon 7000) and higher-performance refresh RV200 (Radeon 7500), the latter two having dual-monitor support.

który trafił do sprzedaży April 1, 2000

#technologia #gpu #amd #ati #kiedystobylo