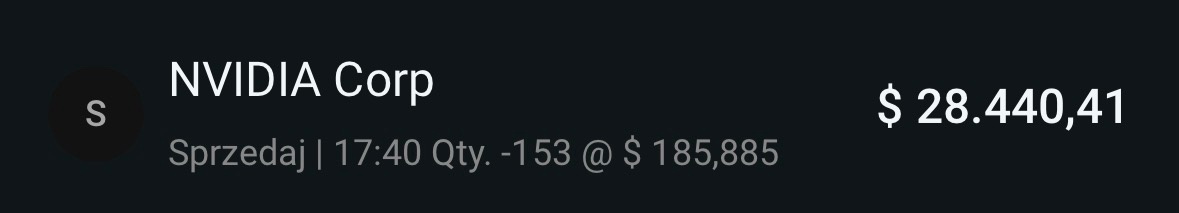

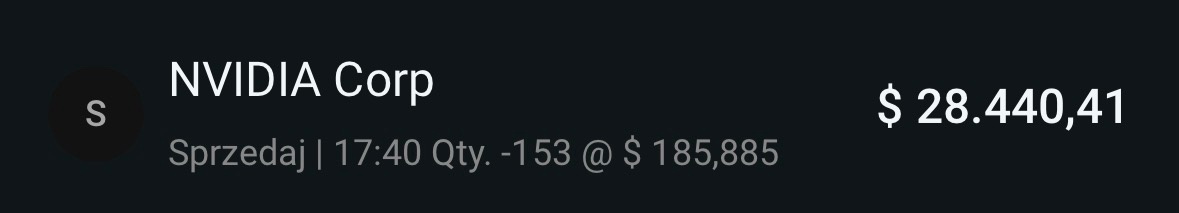

Nastala ta chwila. Spadnie to znowu kupie :)

#gielda #inwestycje #nvidia

Nastala ta chwila. Spadnie to znowu kupie :)

#gielda #inwestycje #nvidia

Zaloguj się aby komentować

Zaloguj się aby komentować

Jak donosi JayzTwoCents domyślnie sterowniki NVIDIA mają wyłączoną opcję rBAR na poziomie sterownika i ignorują włączoną opcję rBAR w BIOS/UEFI.

https://youtu.be/z-ggq_S3sDQ?t=156

rBAR

Resizable BAR (ang. Base-Address Register) to technika interfejsu PCI-Express. Stanowi ona część specyfikacji PCIe 3.0, ale dopiero od końca 2020 roku producenci sięgnęli po to rozwiązanie, by poprawić wydajność w grach. I NVIDIA wcale nie była pierwsza, choć to właśnie na Resizable BAR w wydaniu „zielonych” skupię się w tej publikacji.

Co robi Resizable Bar? Usprawnia komunikację między CPU a GPU, usuwając ciągnące się od lat ograniczenie z ery 32-bitowej....

I jak tam $tsla $nvda? Urus, zmalau? Koniec tesli?

#gielda #inwestycje #tesla #nvidia

Zaloguj się aby komentować

czy dokupilem nvidii za 5k? byc moze.

#bartektrejduje #nvidia #gielda

Zaloguj się aby komentować

Z Titanem Xp chyba lepiej wygląda ( ͡° ͜ʖ ͡°)

#pcmasterrace #nvidia #komputery #kartygraficzne #gpu

Zaloguj się aby komentować

Zboostowanie 1 litrowego PC zewnętrznym GPU.

#pcmasterrace #nvidia #intel #komputery #ciekawostki #kartygraficzne

Zaloguj się aby komentować

Elo. Posiadam procek i5 4690 i mam do wyboru dwie karty: GTX 1060 3 gb i Radeon rx 470 4gb.

Która będzie lepsza do starszych gierek w dx11? Minusem czerwonych jest wysoki pobór mocy i temperatury,

zaś zieloni mają mniej vramu. Co sądzicie? Wiem, że to starocie, ale kompa będę zmieniał za rok, jak połatają STALKERA 2 xD #komputery

#pcmasterrace #nvidia #amd #kartygraficzne

Zaloguj się aby komentować

#amd #nvidia #kartygraficzne #takaprawda

Sprzedawcy trzymaja się cen MRSP bardzo mocno XD

Zaloguj się aby komentować

Jeśli planowaliście kupno nowych kart graficznych od #nvidia to lepiej dobrze się zastanówcie co robicie. Media zaczynają donosić o sporej ilości problemów:

Użytkownicy kart graficznych GeForce RTX 50 nadal skarżą się na problemy ze stabilnością swoich GPU, w tym na czarne ekrany i awarie systemu, a NVIDIA wciąż nie ma gotowej poprawki.

Oprócz tego:

Premiera serii GeForce RTX 50 jest jedną z najbardziej problematycznych w historii firmy. Gracze i entuzjaści PC muszą zmagać się nie tylko z niedostępnością GPU i wysokimi cenami, ale również z problemem topiących się 16-pinowych złączy zasilania. Dodatkowo pojawiły się wady sprzętowe, np. przypadki kart z mniejszą liczbą jednostek ROP, niż deklarował producent. Do tego wszystkiego wydajność grafik z rodziny Blackwell po prostu rozczarowuje, więc nie rysuje to dobrego obrazu serii RTX 50.

Jeśli ktoś doczytał do tego miejsca to może się zacząć zastanawiać o co chodzi z mniejszą ilością ROP'ów. No to już odpowiadam:

Według licznych doniesień, niektóre modele tej serii mogą posiadać wadę produkcyjną, która prowadzi do scalania partycji ROP (Render Output Unit) w procesorze graficznym, co bezpośrednio wpływa na spadek wydajności urządzeń.

Użytkownik reddita przeprowadził testy swojego RTX 5080 w popularnym benchmarku 3DMark Time Spy. Wyniki okazały się niepokojące – karta osiągnęła wynik 28 118 punktów, podczas gdy sprawna jednostka uzyskuje aż 32 273 punktów. Różnica wynosząca 12% jest ogromna, szczególnie w kontekście urządzeń klasy premium.

https://ithardware.pl/aktualnosci/nvidia_problemy_bsod_rtx_50_poprawki-39245.html

https://ithardware.pl/aktualnosci/rtx_5080_rop_wydajnosc_wpadka_nvidia-39271.html

#gpu #kartygraficzne #technologia

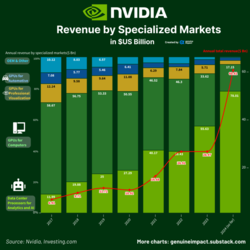

@damw Prawda jest generalnie oczywista, Nvidia ma totalnie w d⁎⁎ie tworzenie konsumenckich kart graficznych dla graczy czy pół profesjonalistów i całą uwagę skupia na akceleratorach AI. Dosłownie nie opłaca im się marnować zasobów ludzkich jak i wolnych przydziałów za zamówienia wafli krzemowych na gałąź biznesu która daje im tak małe przychody w porównaniu do AI. I tak będzie dopóki cała ta bańka nie walnie w końcu.

Ja tutaj tylko zostawię te 3 obrazki:

Zaloguj się aby komentować

Problemów z nową generacją Gefore'ów ciąg dalszy (kolejne opóźnienia):

Jak podaje chiński serwis CTEE, jednym z powodów opóźnienia premiery kart graficznych GeForce RTX 5070 i RTX 5060 są problemy z wydajnością tych modeli. Układy rzekomo nadal wymagają dalszego debugowania. Dodatkowo sytuacji wcale nie ułatwiło niedawne trzęsienie ziemi w Tainan. W rezultacie masowa produkcja została ponoć opóźniona aż o cztery tygodnie, przy czym RTX 5070 ma być dostępny w połowie marca, natomiast RTX 5060 dopiero w połowie kwietnia. Mówiąc krótko, wiele wskazuje na to, że konsumenci będą mieli spore problemy z zakupem tych układów w okolicach premiery

#technologia #kartygraficzne #geforce #nvidia

Zaloguj się aby komentować

Udało mi się kupić wczoraj 5070ti w msrp. Tylko coś jakoś nie wysłali. Sprawdzam dzisiaj status zamówienia a tam "oczekiwanie na dostawę". Coś czuję, że potrzymają chujki kasę przez parę dni i anulują xD

Kocham papierowe premiery ( ͡~ ͜ʖ ͡°)

#pcmasterrace #komputery #nvidia

Zaloguj się aby komentować

wiem, że nie #heheszki, ale i tak #humorinformatykow #pcmasterrace #nvidia ( ͡~ ͜ʖ ͡°) also #zajebanezreddita

Zaloguj się aby komentować

Halo, trzymacie sie?

#gielda #nvidia #bartektrejduje xD

Zaloguj się aby komentować

Dzisiaj troche dokupilem i portfolio prezentuje sie tak:

#gielda #inwestycje #nvidia

Zaloguj się aby komentować

bartek sprzedaje tmc z niezlym zyskiem, tmc spada

bartek kupuje nvidie

nvidia wypierdala sie na ryj w historycznie najwiekszej stracie na nasdaq

tmc wypierdala do gory

bartek placa pieniadze na konto, zeby kupic wiecej nvidii w dolku

nvidia zapierdala do gory

profit? nie znam typa

#gielda #inwestycje #nvidia #heheszki

Zaloguj się aby komentować

Zaloguj się aby komentować

![[ENG] Zapomnij o RTX 5070, wczesne testy porównawcze pokazują, że nawet RTX 5080 nie jest w stanie pokonać RTX 4090](https://cdn.hejto.pl/uploads/posts/images/250x250/123bb171fa3bd721010235ef29ce2e2b.jpg)

NVIDIA twierdziła, że RTX 5070 jest równy 4090 za jedyne 549 USD. Jednak nawet RTX 5080 za 999 USD nie jest w stanie dogonić 4090, nie mówiąc już o pokonaniu go. #technologia #pcmr #pcmasterrace #nvidia #geforce #komputery

#technologia #amd #nvidia #komputery #heheszki

To w końcu wysoka półka, średnia czy jaka? ( ͠° ͟ʖ ͡°)

Zaloguj się aby komentować