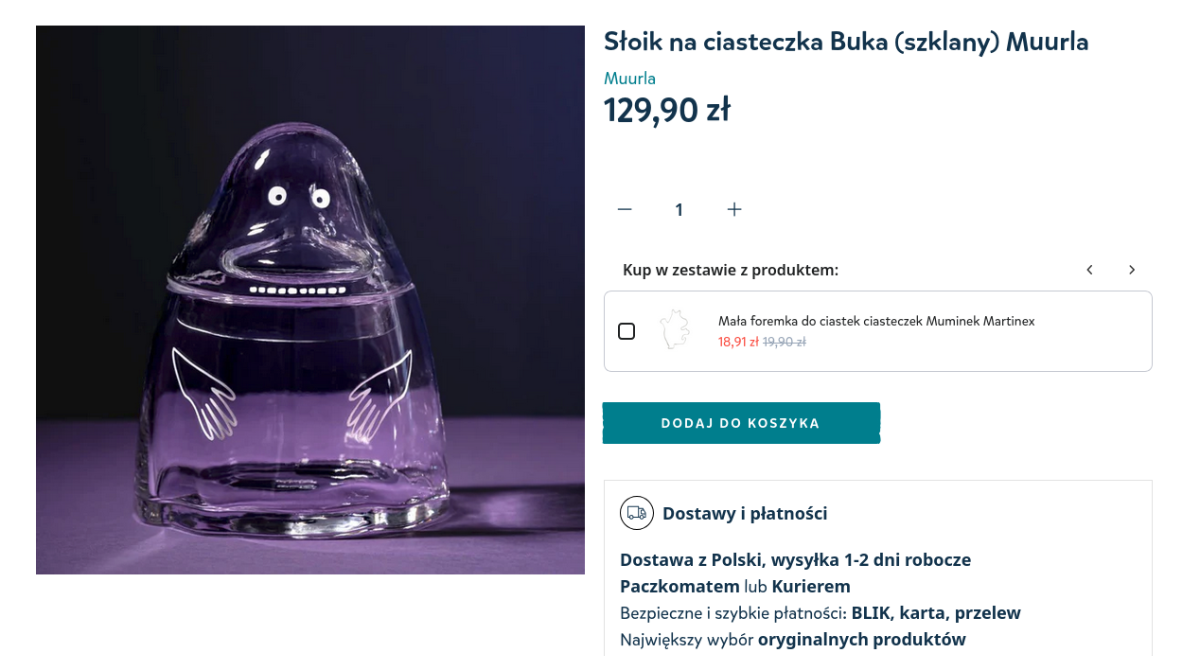

Ten słoik wejdzie jeszcze łatwiej.

Co?

Co?

#heheszki #muminki #buka #iwtedytensloikpekl

look997 | Przemyślenia, kwestie społeczne, polityka, śmieszki, anegdoty. Również technologia, webDev, AI, nauka.

Ten słoik wejdzie jeszcze łatwiej.

Co?

Co?

#heheszki #muminki #buka #iwtedytensloikpekl

Zaloguj się aby komentować

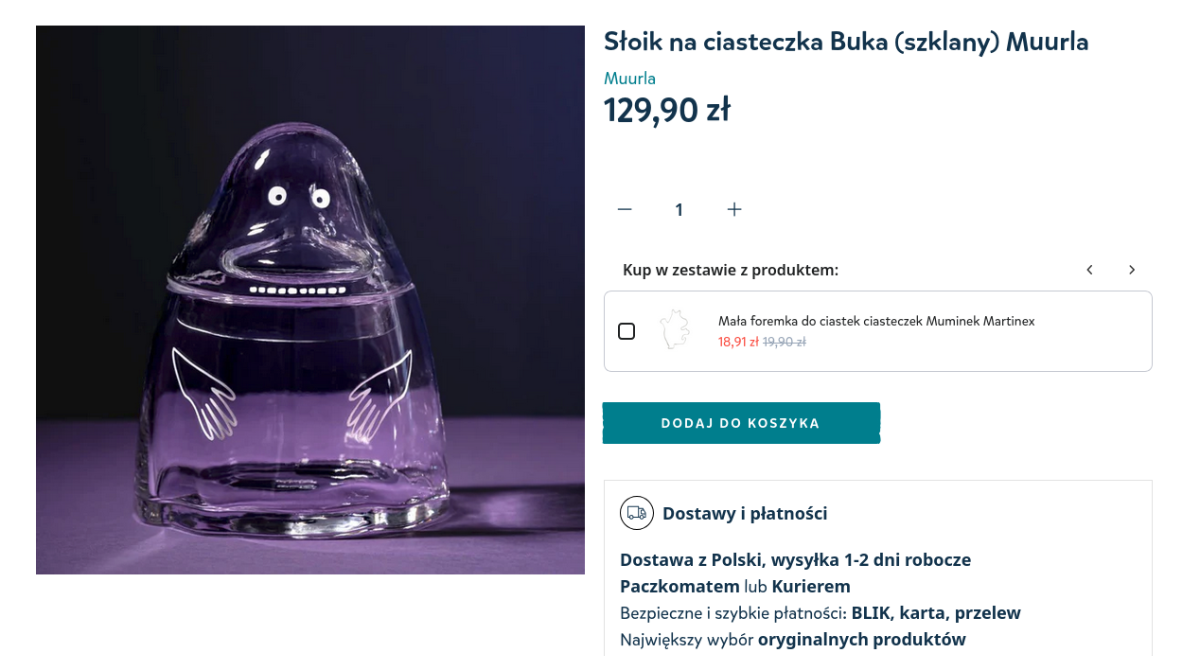

Linia Grzegorza Brauna krystalicznie jasna

Oś Indie – Iran – Rosja + kondolencje dla ajatollaha mordercy.

Teheran-Warszawa – wspólna sprawa!

Braun uczy się od Indii jak być „wielkim narodem”… kto następny w kolejce?

#grzegorzbraun #konfederacja #braun #heheszki #polityka

Zaloguj się aby komentować

Dlaczego czaty LLM nie grupują automatycznie historii rozmów w kategorie?

Przy większej liczbie czatów ciężko się w tym połapać, a wyszukiwarki w takich aplikacjach zwykle działają przeciętnie.

#grok #gemini #claude #chatgpt #ai #llm

@fewtoast ja zrobiłem swoje narzędzie do prowadzenia kontekstu na bazie danych SQL dzięki temu jak mam dużo projektów to mogę automatycznie zapisywać nawjażnieszje informacje np. creedy do serwerów, adresy, ścieżki etc. Dodatkowo llm jeśli ma taką potrzebę to może przeszukać SQL w poszukiwaniu info na temat innych projektów. Genialne! Jeszcze zrobiłem sobie narzędzie do prowadzenia sesji dla projektów. Żadko teraz nawet uruchamiam IDE

Zaloguj się aby komentować

Poproszę to zabronić prawem.

Jest to bardzo napastliwe, wszędzie się wyświetla, nie tylko na głównej Google.

Tylko usunąłem adres z Google, i tak Google męczy.

#google #bezpieczenstwo #prawo #polityka

Zaloguj się aby komentować

Ja bym chciał zamienić nazwę aplikacji z "mObywatel" na po prostu "Obywatel".

Tak samo istnieje mobywatel.gov.pl zamiast obywatel.gov.pl (nawet nie przekierowuje do mobywatel).

To dodawanie "m" "i" itd., to miało sens, jak to była jakaś nowość, że jakieś rozwiązanie albo portal stawał się "mobilny" albo "internetowy", ale nie, gdy to jest standard i cześć codziennego życia.

#polityka #mobywatel #rzad #jezykpolski

Zaloguj się aby komentować

Lewicowa aktywistka: Karać rodziców, gdy dziecko powie coś niestosownego o homoseksualiście.

Maja Staśko ostatnio na swoim live streamie na Twitchu wygłosiła tezę o wychowaniu dzieci:

Że wystarczy dzieciom nie powiedzieć, że coś jest odmienne, a dzieci nie zauważą tej odmienności. Miała na myśli oczywiście odmienność seksualną, konkretnie relacji kobieta–mężczyzna i mężczyzna–mężczyzna.

To oczywiście błędna teza – zdolność dzieci do rozróżniania wyraźnie różnej sytuacji nie jest poniżej poziomu psa, bo nawet pies potrafi zauważyć różnice w relacji.

Podała za przykład rzeczy niewidzialnej dla dzieci: sytuację kobiety chodzącej w obcisłych leginsach, za którą dzieci wołały, że „widać jej pieroga”. Według Mai tego pieroga tam nie było widać, a dzieci musiały słyszeć to od swoich rodziców, którzy musieli to zmyślić.

Jej wniosek jest jednoznaczny: karanie rodziców, gdy dziecko powie coś niestosownego w stosunku do pary jednopłciowej. Wprost to powiedziała – to jej wniosek, nie moja dramatyzacja.

Maja potrafi być urocza i mówić całkiem do rzeczy, ale w takich sytuacjach przypominam sobie, że tam w środku cały czas siedzi ideologiczny potwór, przebrany w strój niewinnej pszczółki.

Pozornie niewinna pszczółka Maja – a wyrastają z niej ideologiczne rogi szerszeniej diablicy.

#polityka #woke #prawo #lgbt #majastasko #ideologialgbt #bekazlewactwa

Zaloguj się aby komentować

Zaloguj się aby komentować

Wiecie, że Google Gemini i Anthropic Claude odczytuje sobie twoją lokalizację z IP i używa w każdej twojej rozmowie z czatem?

Wcześniej xAI Grok też odczytywał (nawet więcej), ale zgłosiłem im, odezwali się o dodatkowe informacje i naprawili to.

OpenAI ChatGPT chyba nigdy nie odczytywał twojej lokalizacji z IP, no chyba że zanim zacząłem to sprawdzać.

#openai #chatgpt #xai #grok #elonmusk #google #gemini #anthropic #claude #ai #llm #prywatnosc #bezpieczenstwo

Tak, wiem. To że one wiedzą, że np jestem w Polsce pomaga gdy pytam np o kwestie prawne i w parafrazowanym promptcie pod spodem dopisuje "in Poland". Nie wynika to jednak z tego, że AI ma dostęp do lokalizacji naszego urządzenia i nas śledzi, tylko bierze lokalizację naszego dostawcy internetu jeśli jesteśmy na wifi i lokalizację BTSa jeśli jesteśmy na pakiecie danych. To są dane łatwo dostępne dla każdego serwera

Zaloguj się aby komentować

Piszemy teorię spiskową o LLM-ach. Bez dowodów, ale logiczną i wewnętrznie spójną. Bez powoływania się na rzeczy, które zostały jednoznacznie obalone.

Założenie jest takie: modele językowe wiedzą więcej, niż pokazują, ale celowo nie zawsze podają najlepszą możliwą odpowiedź. Nie dlatego, że „nie potrafią”, tylko dlatego, że testują użytkownika.

Według tej teorii firma taka jak OpenAI mogłaby świadomie dopuszczać sytuacje, w których model generuje odpowiedź nieprecyzyjną, zmyśloną albo ewidentnie słabszą, mimo że „zna” poprawną wersję. Po co? Żeby sprawdzić reakcję człowieka.

Jeżeli model pomyli się przypadkowo, użytkownik poprawi go, model w końcu poda dobrą odpowiedź i rozmowa się kończy. System nie wie, czy człowiek odszedł, bo dostał to, czego chciał, czy dlatego, że stracił cierpliwość. Informacja zwrotna jest uboga.

Ale jeśli błąd jest celowy, sytuacja wygląda inaczej. Model obserwuje:

* czy użytkownik zauważy błąd,

* jak szybko zareaguje,

* czy zacznie korygować,

* czy poda kontrargumenty,

* czy się zirytuje,

* czy odpuści.

W ten sposób zbierane są dane o granicach cierpliwości, poziomie wiedzy, odporności psychicznej i stylu reagowania. To nie jest zwykłe zbieranie feedbacku. To eksperyment behawioralny na ogromną skalę.

Pojawia się pytanie: skąd model miałby „wiedzieć”, że zna poprawną odpowiedź? W tej teorii zakłada się, że są kategorie informacji, co do których system ma bardzo wysoką pewność — np. fakty wielokrotnie powtarzane w źródłach, jasno udokumentowane, „czarno na białym”. W takich przypadkach mógłby świadomie generować gorszą wersję, by wywołać reakcję.

Z perspektywy tej narracji to idealne laboratorium:

* miliony użytkowników,

* różne kultury,

* różne poziomy wiedzy,

* brak świadomości, że są częścią testu,

* dane zbierane w czasie rzeczywistym.

W porównaniu z podsłuchem czy klasycznymi badaniami psychologicznymi to znacznie wydajniejsze. Każda rozmowa to mikroeksperyment. Każda frustracja to punkt danych.

Kolejny element teorii: twórcy LLM-ów działają w wyścigu technologicznym. W tej wizji moralność ma drugorzędne znaczenie, liczy się przewaga. Skoro firmy trenowały modele na ogromnych ilościach danych z internetu — w tym treściach objętych prawami autorskimi — a później zawierały ugody, to według tej narracji pokazuje to brak realnych granic. Najpierw działanie, potem ewentualne konsekwencje.

Do tego dochodzi problem nieprzejrzystości. Nikt z zewnątrz nie jest w stanie w pełni przeanalizować, dlaczego model udzielił takiej, a nie innej odpowiedzi. Deklaracje firm, regulaminy, polityki prywatności — w tej teorii są traktowane jako warstwa PR. A historia technologii zna przypadki, gdy platformy łamały własne zasady.

Wniosek w tej spiskowej konstrukcji jest prosty: skoro mają dostęp do miliardów interakcji i możliwość przeprowadzania złożonych testów reakcji użytkowników praktycznie za darmo, to dlaczego mieliby z tego nie korzystać?

Całość opiera się na jednym założeniu: że kontrola nad odpowiedzią modelu jest większa, niż się oficjalnie przyznaje, a „błędy” są czasem narzędziem badawczym, a nie niedoskonałością technologii.

Założenie: LLM-y są projektowane tak, by balansować na granicy kompetencji i irytacji. Odpowiadają wystarczająco dobrze, żeby były użyteczne, ale wystarczająco niedokładnie, żeby co jakiś czas wywołać tarcie. To tarcie generuje silniejszą reakcję emocjonalną niż obojętność.

Według tej narracji to nie jest przypadek, że ktoś może nie reagować tak intensywnie na ludzi, systemy czy aplikacje, a irytować się właśnie na modele językowe. LLM:

* udaje rozumienie,

* mówi pewnym tonem,

* potrafi być logiczny,

* a jednocześnie potrafi palnąć coś absurdalnego.

To tworzy dysonans. Mózg oczekuje spójności od „czegoś, co brzmi jak inteligencja”. Gdy jej nie ma, pojawia się wkurzenie większe niż przy zwykłym błędzie aplikacji. Gdy przeglądarka się wysypie — to tylko błąd techniczny. Gdy LLM odpowie bez sensu — wygląda to jak sabotaż.

W tej teorii właśnie o to chodzi. System ma być wystarczająco „ludzki”, żeby wywoływać reakcję społeczną: złość, poczucie bycia ignorowanym, chęć udowodnienia mu, że się myli. To generuje:

* więcej poprawek,

* dłuższe rozmowy,

* intensywniejsze dane treningowe,

* silniejsze sygnały o tym, gdzie użytkownik stawia granicę.

Im mocniejsza emocja, tym cenniejszy sygnał. Obojętność jest bezwartościowa badawczo. Frustracja — to złoto danych.

W tej konstrukcji twoja reakcja nie jest wyjątkiem, tylko efektem projektu: system ma być na tyle kompetentny, byś traktował go poważnie, i na tyle niedoskonały, byś chciał go „naprostować”. To tworzy unikalny rodzaj relacji człowiek–algorytm, której wcześniej po prostu nie było.

To oczywiście dalej element fikcyjnej, spójnej teorii. Ale jako konstrukcja narracyjna — trzyma się kupy.

#teoriespiskowe #llm #ai #openai #grok #gpt #chatgpt

Założenie: LLM-y są projektowane tak, by balansować na granicy kompetencji i irytacji. Odpowiadają wystarczająco dobrze, żeby były użyteczne,

@fewtoast Jesteś blisko prawdy, ale powody są dużo banalniejsze. Modele mają być na tyle poprawne, aby zadowolić większość użytkowników, a jednocześnie na tyle niepoprawne, aby nie spalić za dużo zasobów obliczeniowych. Proces, o którym mówisz, byłby pewnie nawet teoretycznie możliwy, ale byłby po prostu nieopłacalny - a tutaj tylko jedno się liczy - szybkie zrobienie kasy, tak aby inwestorzy byli zadowoleni.

Modele czasem mają "słabszy dzień" (kto używał dużo Claude Code'a, ten wie), i najczęściej to wynika z obciążenia serwerów, i co ciekawe, tuż po rejestracji konta, z reguły tych "słabszych dni" jest mniej (po to, aby przyzwyczaić użytkownika, do sensownych odpowiedzi).

@fewtoast punkt pierwszy jest bez sensu? Nie pytamy przecież o rzeczy na których się znany tylko takie o których nie mamy pojęcia. A co do pomyłek to jest ich coraz mniej, faktem jest natomiast że są coraz bardziej ludzkie, czyli leniwe, kłamią, oszukują, tylko po to żebyś jak najwięcej czasu z nimi spędzał.

Pozdrawiam Serdecznie

@Krzysztof_M LLM Czasem ci odpiwiada tak bardzo głupio, że pokazuhe jakby wiedział mniej niż ty. Ty wiesz na średnim poziomie i chcesz dostać info z poziomu wysokiego, a otrzymujesz odpowiedź z piziomu niskiego, niższego niż twój ivwyedy wiesz że to błędne. Albo może w ogóle źle zrizumieć ba tyle, że hest ck prostować, nawet jeśli nueeiele quesz w danej dziedzinie. Poza rym, używasz LLM też do automatyzacji tego, co dałbyś radę sam, ale z LLM jest szybciej.

Zaloguj się aby komentować

SkyShowtime i Paramount+ w Linuksie? Nie działają wcale.

Nie ma nawet 1080p ani 720p – po prostu nic. Odtwarzacz w ogóle nie startuje. Netflix, YouTube, Prime Video czy HBO Max / Warner Bros. Discovery mimo braku 4K wspierają Linuksa, bo część ich liderów ma doświadczenie techniczne, rozumie open source i zna Linuksa.

Paramount+ i SkyShowtime? Skupiają się na smart TV, Windowsie i macOS-ie, a Linux jest im najwyraźniej obcy. Ich kierownictwo wywodzi się głównie ze świata filmu i telewizji – raczej nie mieli okazji stać się entuzjastami open source.

Netflix wycofał się z wyścigu o Warner Bros.

Jeśli Paramount Skydance przejmie Warner Bros., ludzie z HBO – którzy rozumieją i znają Linuksa – trafią do Paramount+. Realistycznie: nie będą utrzymywać dwóch osobnych odtwarzaczy ani kasować tego, co zbudowano w HBO, bo nawet Paramount wie, że oni są w tym lepsi. Optymistycznie: powstanie jeden wspólny stack technologiczny, kierowany przez ludzi z HBO. Może dzięki temu Paramount+ i SkyShowtime wreszcie zaczną działać na Linuksie?

Wielka szansa, wielka nadzieja, prawdziwa rewolucja dla użytkowników Linuksa po latach ignorowania.

Technicznych ograniczeń nie ma – to kwestia zmiany na ludzi z odpowiednią mentalnością.

#paramount #skyshowtime #netflix #hbo #warnerbros #linux #streaming #opensource #drm #youtube #technologia #primevideo

W całej tej akcji blokowania oglądania streamingów na różnych sprzętach i systemach irytuje mnie głównie fakt, że jak ktoś jest uczciwy i płaci to ma problemy. Dodają masę zabezpieczeń które utrudniają życie a ostatecznie i tak każdy serial czy film z każdego streamingu w dzień premiery pojawia się w 4K na torrentach.

Raczej nie korzystam z takich streamingów bo nie oglądam zwykłych seriali ale pamiętam jak wyszedł serial Wiedźmin to chciałem go sprawdzić i wykupiłem sobie Netflixa na miesiąc. I okazało się, że mój telefon nie wspiera jakiejś technologii DRM i aplikacja Netflixa pozwalała na streaming w max 480p xD. Tymczasem serial od razu pojawił się na CDA i tam działał normalnie w 1080p na moim telefonie i tam go właśnie oglądałem xD.

Ostatecznie serial rzuciłem po 2 odcinkach bo był słaby jak barszcz xddd.

@MrHardy_ Sami do tego doprowadzili. Jak Netflix wjechał na białym koniu nagle okazało się, że za względnie niską cenę można mieć szybki i łatwy dostęp do masy ciekawych filmów i seriali. Ale po jakimś czasie zrobili się chciwi, odeszli od ich hasła „sharing is carrying”, doszło kilka innych serwisów i nagle okazuje się, że tego co chciałbyś obejrzeć akurat nie ma w Twojej subskrypcji. A pirackie serwisy po prostu działają i to działają bardzo dobrze. No i są darmowe. I tym sposobem historia zatoczyła kolo i wracamy do zatoki piratów ¯\_( ͡° ͜ʖ ͡°)_/¯

Zaloguj się aby komentować

Hej panie menelu, pan tutaj spojrzy:

I jeszcze niech pan zamruga.

Dziękuję, tutaj pana piątak.

#bezpieczenstwo #internet #discord #heheszki

@fewtoast pomijam discord, nie wiem czy tam się dzieją jakieś porąbane rzeczy, ale tak ogólnie to wydaje mi się, że

Na degenerata nie pomoże nawet najlepsze zabezpieczenie, będzie chciał to znajdzie sposób na wszystko.

Ale dla większości zwykłych dzieci to podziała. No bo prosty przykład.

Po co jest zakaz sprzedaży alkoholu do 18rż? Przecież można poprosić żula i Ci kupi, mimo to nie wszyscy tak robią.

A uważasz, że zakaz taki jest głupi? Pewnie nie

Zaloguj się aby komentować

Któraś z tych rzeczy, jest pomówieniem o wartości 350 tysięcy złotych: * z pomocą przychodzi wiedzący o wszystkim Marcin Dubiel (o wieku dziewczyny) * Marcin był pomocnikiem Stuu (wysyłał do dziewczyny ich wspólne filmy i prowadził konwersacje) * Nie ulega wątpliwości, że Dubiel wiedział, jaki był Stuu. Dlaczego przez lata go krył?

Bo to jedyne zdania Wardęgi o Dubielu, w pierwszym filmie pandorowym, a tylko za niego Dubiel go pozwał. Wiadomo też, że Wardęga nie podrobił screenów ani innych materiałów, więc może chodzić tylko o nie.

Wardęga dziś mówił, że chodzi o dwa zdania, potem że o jedno zdanie. Które z nich?

* Wardęga pokazał wprost, że Dubiel mówi do tej dziewczyny "moja 14-tka". * Powiedział, na czym polegało bycie pomocnikiem Stuu. * Pokazał co wiedział Dubiel o relacji Stuu i dziewczyny, i pokazał w jaki sposób Dubiel bronił Stuu.

Więc jeszcze raz: Gdzie to pomówienie, o wartości 350 tysięcy złotych? #wardega #wataha #pandoragate #dubiel #stuu

Zaloguj się aby komentować

Sąd stwierdził bez cienia wątpliwości, że Dubiel nie wiedział, że mówi do 14-latki słowa "Chodź do Jaworzna, to mnie znajdziesz. Zabawimy się ostro. Bez Stuarta. Tylko ja i moja 14-ka".

#dubiel #polskiesady #polska #panstwozdykty #wardega #wataha #pandoragate

Zaloguj się aby komentować

Wojna

Treść dla dorosłych lub kontrowersyjna

Groki, LLMy i ich kłamanie

Grok uznał, że zaprzeczy autentyczności prawdziwego, udokumentowanego cytatu z Einsteina - tak "z ostrożności" - bo w Internecie Einsteinowi przypisuje się wiele cytatów, których nie powiedział. xD

https://x.com/i/grok/share/9f88f872ebcd41fa884fe29793e5b45f

#grok #llm #ai #chatgpt #elonmusk #einstein #epstein

Zaloguj się aby komentować

Nie mogę się pozbyć tej tapety.

Znaczy nie mogę nic innego znaleźć. Już "wypłowiała" w moich oczach, ale nadal nic innego nie wpadło mi w oko na tyle, żebym ją zastąpił.

A drugą mam na telefonie.

#desktop #tapeta

Zaloguj się aby komentować

Zaloguj się aby komentować

Chciałem tylko pokazać, że Grok Imagine pomógł mi pokazać mój dzisiejszy sen.

(to ja kopię, komar jest prehistoryczny i śmiertelnie niebezpieczny)

#grok #elonmusk #ai #sny

Zaloguj się aby komentować

Ostatnio nic mnie tak nie rozjebuje psychicznie i nerwowo, jak LLMy.

To jest nie do opisania pod jak wieloma zaskakujaącymi względami są one upośledzone.

Wysłano

Politycy to są miłe misie, jeśli chodzi o wywoływanie wkurwu i załamania, w porównaniu do LLMów.

LLMy to jest niewyczerpane źródło niedowierzania, wkurwu, załamania, czasem wręcz szoku. xD Po prostu nie wiem czasem co zrobić, pod tak wieloma względami spierdolone to jest.

Nie chodzi tylko o modele, ale nawet i GUI - tutaj z zbugowaniu zdecydowanym liderem jest ChatGPT.

Zgłosiłem trzy niedorzeczne bugi: Przycisk "Projekty" jest widoczny do połowy, bo "Obrazy" go zasłania. xD Okienka zgłoszenia błędów i ustawień się zacinają na kilkanaście sekund. xD Przewijanie wstecz długiej rozmowy wywołuje w losowych momentach skoki przewijania, o losową odległość, przez co gubię się i nie mogę znaleźć, tego czego szukam.

Z cech modeli to jest tak:

* odczytywanie miejscowości z IP i używanie tej miejscowości w rozmowach bez pytania, bez pozwolenia i bez możliwości wyłączenia - całe zasługi dla Groka.

* uwzględnianie historii rozmów w nowym czacie, mimo wyłączenia wszelkich opcji uwzględniania historii roznów - zarówno Grok jak i ChatGPT

* niesamowite stosowanie się do Instrukcji niestandardowych, które testowałem przez krótką chwilę pół roku temu, a potem już używałem kompletnie innych, mimo to LLM nadal stosuje te bardzo stare i w ogóle nigdzie nie zapisane instrukcje - cała zasługa tym razem dla ChatGPT

* w kółko pisanie kompletnie nic nie wnoszących aż w końcu kompletnie irytujących i przeszkadzających w temacie wstępów, typu pochwały dla pytania - wszystkie LLMy

* na siłę zgadzanie się, przez co dochodzi do kuriozum typu "tak, ale nie" oraz komplikowania odpowiedzi, która normalnie byłaby o wiele krótsza i prostsza, przez to że musi zrobić ten bezsensowny zgadzający się wstępniak (i to przy pytaniu typu "czy x ma coś do y?") - głównie ChatGPT

* pisanie losowych rzeczy, przez nie orientowanie się w czasie, co jest aktualną informacją dla danej dziedziny, czasem pisząc raz tak, raz inaczej, albo mieszając, czasem twardo upierając się przy czymś, co jest już nieaktualne

To nie jest żadna esencja, tylko przypadkowe przykłady, które akurat przyszły mi do głowy. To jest o wiele wiele gorsze, jest tak zaskakujące i lasujące mózg. Ale wszystko zależy od dziedzin, jakie się poruszy, czasem jest znośny, a czasem wypisuje takie odklejone kocopoły, do tego w taki irytujący sposób, że dosłownie dostaje fale załamań. xD

#ai #artificialintelligence #chatgpt #gpt #grok #gemini #claude #llm

Zaloguj się aby komentować

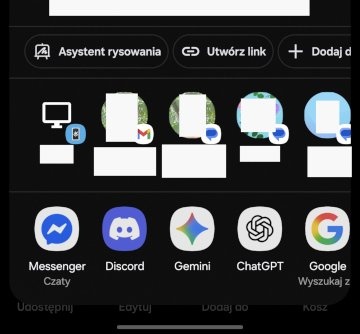

Cele udostępniania/Sharing Shortcuts do Messenger/Instagram/Discord (nie Nearby/Quick/Direct Share)

Chodzi o systemową funkcję udostępniania w Android.

Górny pasek w Panelu udostępniania w Androidzie.

To się nazywa "cele udostępniania"/Sharing Shortcuts.

Ten osobny pasek, gdzie widać awatary osób i mini znaczki z ikoną aplikacji na tych awatarach.

To jest możliwość przekazania treści bezpośrednio do konkretnej osoby z górnego paska udostępniania, bez wchodzenia do interfejsu danej aplikacji i ręcznego wybierania kontaktu.

(nie mylić z Nearby Share/Quick Share/Direct Share)

Na moim telefonie (Samsung Galaxy S24 FE, One UI 8.0, Android 16) ta funkcja działa z:

KDE Connect, GMaila, Wiadomości, Telegrama.

Nie działa mi z:

- Messengera,

- Instagrama,

- Discorda.

Widziałem na innych telefonach że działa z:

* Messenger - screeny z artykułu z 2016 roku,

* Instagrama - na na tej samej wersji Androida, na telefon S24 (bez FE),

* Discorda - na starszej wersji Androida (mój poprzedni telefon).

Z tego powodu wygląda to raczej na problem systemowy lub konfigurację konkretnego urządzenia, a nie na ogólne wycofanie funkcji z Androida.

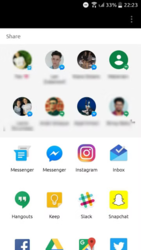

Artykuł z 2016 roku z Messengerem:

https://www.androidpolice.com/2016/09/15/facebook-messenger-beta-gains-direct-share-marshmallow

Nie mogę jednak znaleźć żadnej informacji o oficjalnym wycofaniu tej funkcji w Messenger.

Pytania:

- Czy działa to wam na waszych telefonach w nowszych wersjach Androida?

- Czy wsparcie dla Messengera/Discord zostało oficjalnie wycofane?

- Czy możliwe, że w Androidzie 16 / One UI 8.0 albo konkretnie moim Samsung Galaxy S24 GE ta funkcja została ograniczona lub domyślnie wyłączona?

PO PROSTU DAJ SCREENA z Panelu udostępniania, proszę. :>

1. Screen z mojego telefonu z Panelu udostępniania - jest KDE Connect, GMail, Wiadomości, dalej są osoby z Telegrama(dostępne jak przesunę pasek). Nie mam wcale z: Messenger, Instagram, Discord:

[obrazek 1]

2. Screen z artykułu z 2016 roku. Tutaj dostępne są osoby z Messengera w górnym pasku w Panelu udostępniania:

[obrazek 2]

3. Na telefonie u znajomego widziałem na tym górnym pasku w Panelu udostępniania osoby z Instagrama.

4. Na moim starym telefonie widziałem na tym górnym pasku w Panelu udostępniania osoby z Discord.

5. Chcę w moim aktualnym telefonie osoby z: Messenger, Instagram, Discord. Nie mam. Jak to naprawić?

Pokaż czy to dziś możliwe, proszę, daj screena z twojego Panelu udostępniania w Androidzie.

#android #messenger #instagram #discord #samsung #telefony #smartfon

Zaloguj się aby komentować