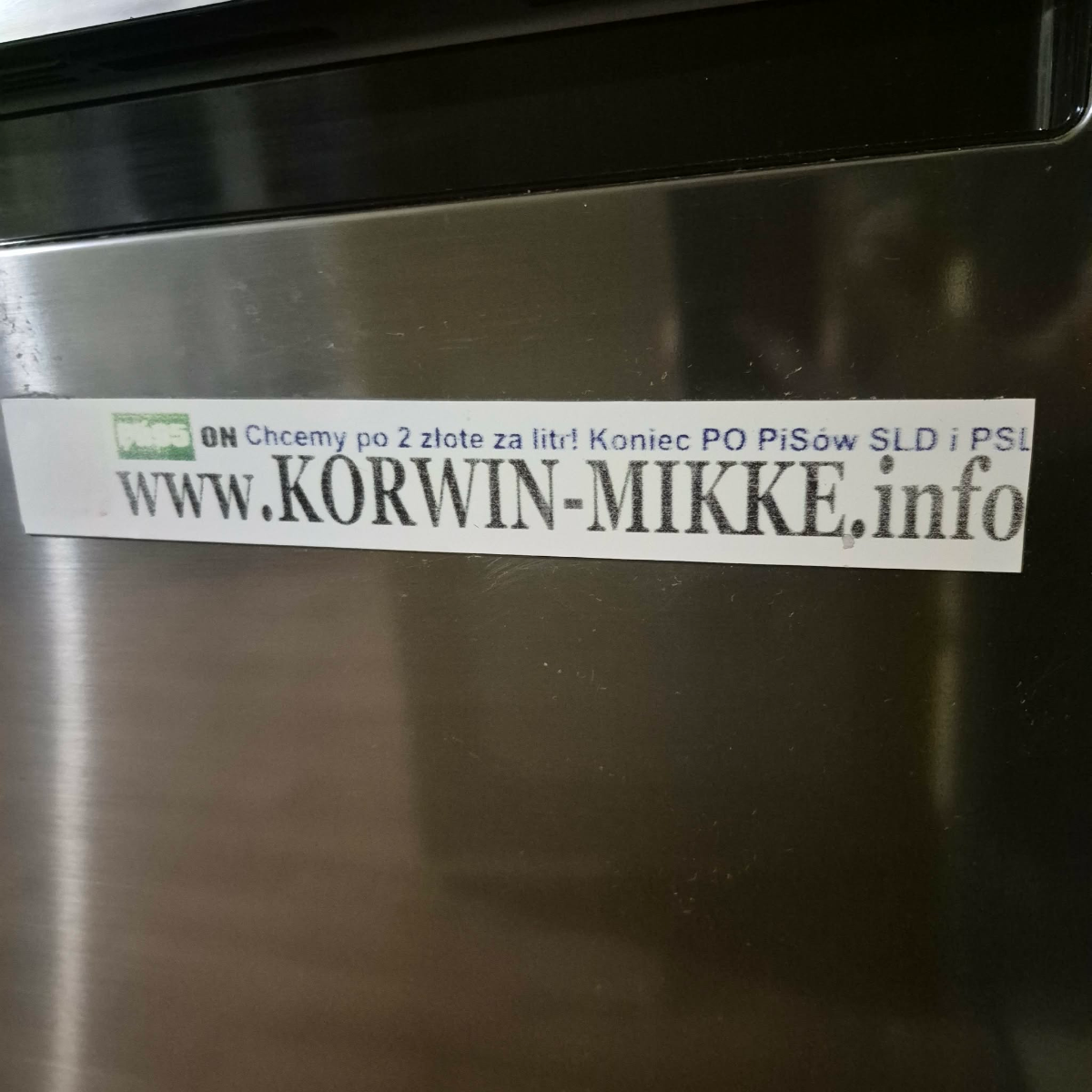

Mogliśmy mieć po 2 złote za litr...

#polityka #orlen #cpn #iran

look997 | Przemyślenia, kwestie społeczne, polityka, śmieszki, anegdoty. Również technologia, webDev, AI, nauka.

Mogliśmy mieć po 2 złote za litr...

#polityka #orlen #cpn #iran

Zaloguj się aby komentować

Jeśli chcemy regulacji LLMów, to zacznijmy do wymogu:

* oznaczania włączania trybu gorszej jakości

* niższych opłat za tokeny, gdy włącza się tryb gorszej jakości

Pod sankcją bardzo wysokich kar, przy nie oznaczaniu.

https://x.com/realtek12345/status/2043023712245502238

#llm #chatgpt #ai #claude

@fewtoast jest to oczywiste. Subskrypcje nie pokrywają kosztów nawet w 50 proc. Troszke już wcześniej o tym pisałem. Jest powoli presja na realizację zyskow a ich jak nie było tak nie widać. Moim zdaniem pod koniec roku microsoft wykupi resztę chatgpt za przysłowiową złotówkę bo będzie bankructwo i wtedy wszyscy podniosą ceny za subskrypcje drastycznie. Będzie to zmowa a pokiereszowac plany tej zmowy mogą chińskie modele

Może nawet się zdarzyc że tryb ai w przeglądarce bedzie platny

Zaloguj się aby komentować

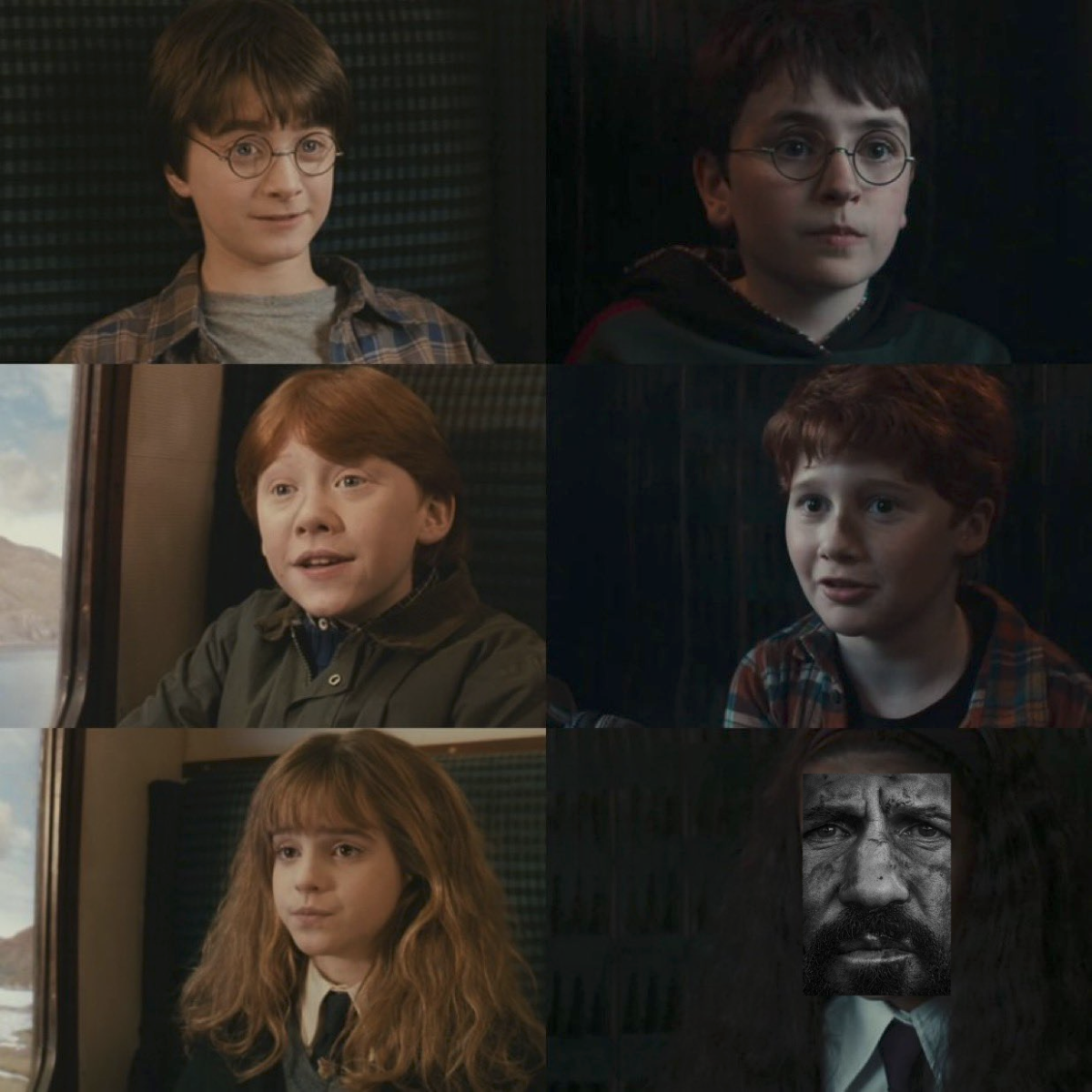

Ciekawe zjawisko z czarnym Snape: Ludzie znów go nie lubią.

#harrypotter #seriale #warnerbros #hbomax #hbogo #snape #jkrowling

@fewtoast znów? Ja bym raczej powiedział, że oryginalnego Snape'a nie tyle ludzie nie lubili na zasadzie nienawiści, co czuli do niego antypatię. Faktycznie "nie lubić" to ludzie nie lubili Umbridge i tutaj duże propsy dla Imeldy Staunton, która tak doskonale odegrała swoją rolę, że my jako widzowie odczuwaliśmy fizyczną nienawiść do odgrywanej postaci- to potrafi być za⁎⁎⁎⁎ście trudne do osiągnięcia.

Natomiast ten ghetto-Snape to jest kompletnie inny casus. Ludzie nie "nie lubią" jego jako odgrywanej postaci, tak samo jak ludzie tak naprawdę nie "nie lubią" jego jako aktora i z pewnością nie "nie lubią" go dlatego, że on jako aktor jest czarny. Po prostu ludziom się nie podoba, że wcisnęli go w tę rolę mimo, że on tam nie pasuje ze względu na cechy fizyczne, jakie posiada. Najprostsze wytłumaczenie: Snape nie był czarny. Tyle.

I wytłumaczenie tego skąd Paapa Essiedu się tam w ogóle wziął jest dużo prostsze i pragmatyczniejsze, niż sztuczki twórców serialu, czy inny "hate watching". Harry Potter to Warner Bros. Warner został teraz przejęty przez Paramount i mimo, że w umowie mają zapewnioną niezależność, to nie ma co się oszukiwać- WB będzie robić teraz wszystko, żeby nie wtopić przed nowym inwestorem, który wybulił na nich- jakby nie patrzeć- w c⁎⁎j siana. A że sytuacja jest jaka jest i te wszystkie blm-dei-dajwersity-srity-tity ruchy jeszcze do końca nie wyzdychały, to po prostu postanowili chuchać na zimne. Że im się to odbije czkawką i krytyką fanów- z pewnością, ale przynajmniej nie będą mieć na karku wojujących pierdolców, którzy widząc, ze c⁎⁎ja by zdziałali wyjąc do WB od razu by polecieli wyżej robić gnój. A wyżej jest Paramount.

Zaloguj się aby komentować

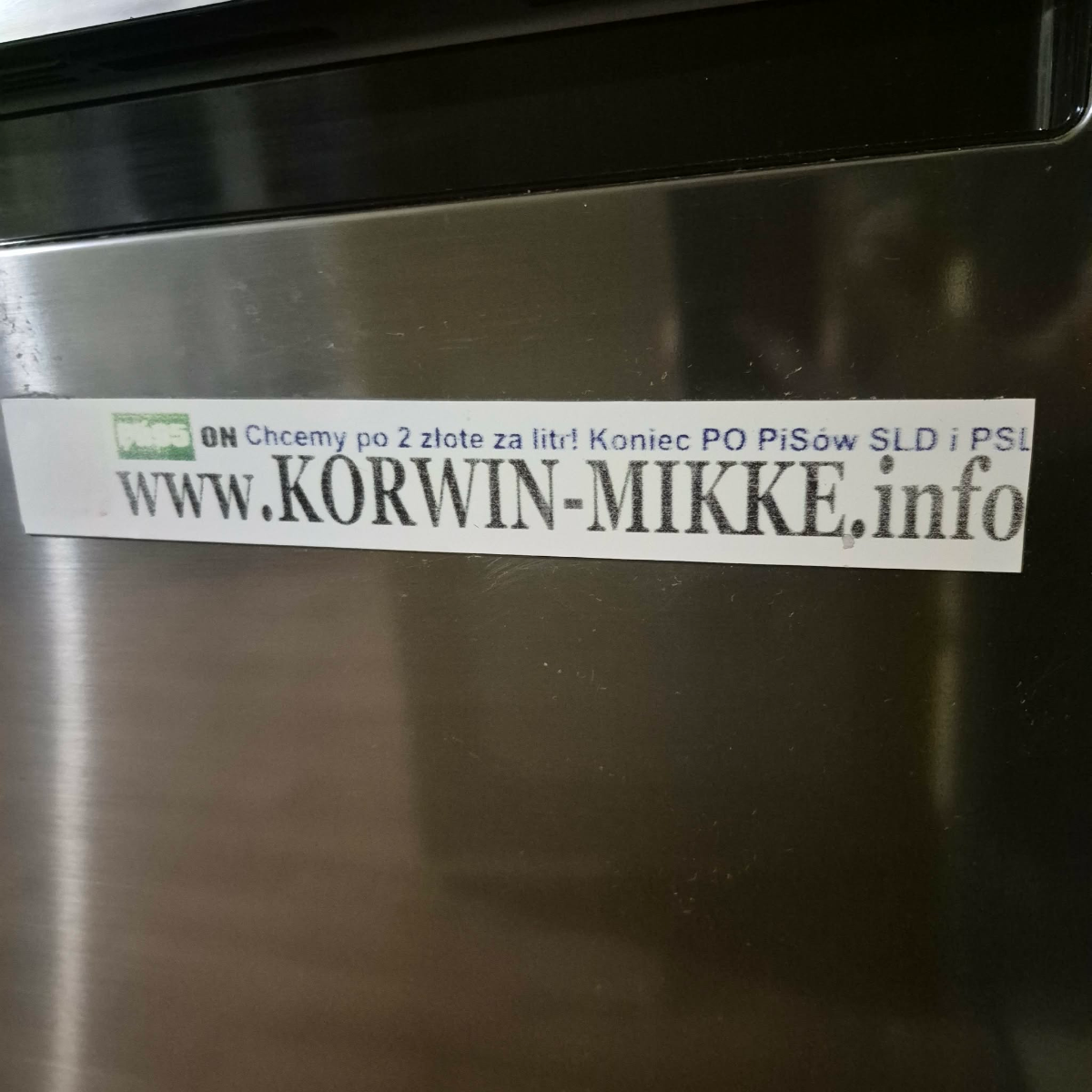

Wiem co bym chciał: Obowiązkowe (pod groźbą bana) oznaczanie kont i chociaż wiadomostki pisanych przez boty, i w YouTube (czy innej platformie).

Opcja, że np.: ja nie chcę dostawać wiadomości od bota ani mieć w polecanych filmów od bota, że taka blokada na to - nie chce mieć styczności bezpośredniej z botem.

Bo taki bot ci przyjcie, i coś bełkocze w odpowiedzi. I czemu ty masz się z tym użerać w miejscu dla ludzi, czyli w komentarzach?

Nie mam nic przeciwko, jeśli boty będą pisały w wartościowy sposób, ale one takie nie są. Jak widać, generują tylko bełkot.

#ai #llm #bot #chatgpt #youtube

Zaloguj się aby komentować

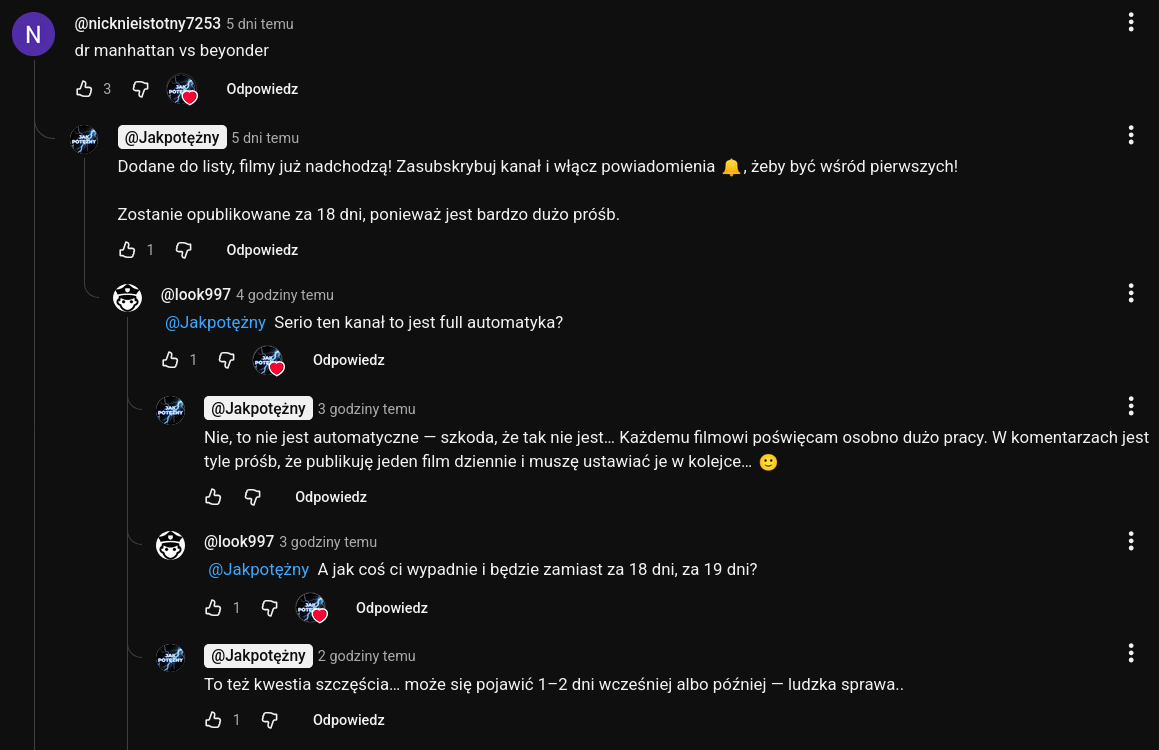

Dodali ekstra filtrowanie wpisów z profilu

Nadal nie dodali filtr "tylko wpisy"

Więc nadal nie mogę zobaczyć samych wpisów danej osoby, bez podanych dalej.

#elonmusk #twitter #userinterface

Zaloguj się aby komentować

Nowa Hermiona wygląda jakby miała pobrudzoną twarz w tej scenie.

#harrypotter #hbogo #hbomax #hermiona #punisher #marvel #daredevil #mcu

Zaloguj się aby komentować

Czy odwrócono krzywdę Tomasza Komendy? NIE!

Bezpowrotnie odebrano mu potencjalne 1/4 życia z marszu a resztę życia miał w ogromnym cierpieniu psychicznym, był niezdolny do życia w społeczeństwie i nadal w jakiś sposób był napiętnowany.

Tylko że umarł na raka dość szybko po wyjściu z więzienia, więc zabrano mu gdzieś POŁOWĘ ŻYCIA.

Wyrok kary śmierci został wykonany w 3/4 (zabrano mu 18 z 24 pozostałych lat życia, licząc od momentu pójścia do więzienia) - Jakkolwiek to brzmi, to tak właśnie się wydarzyło.

Zadośćuczynienie dostanie jego dziecko i zdążył spłodzić to dziecko - to jedyne co uzyskał. I może trochę odzyskaną sprawiedliwość.

#tomaszkomenda #karasmierci #sadownictwo #prawo #stanowski #klodzko

Zaloguj się aby komentować

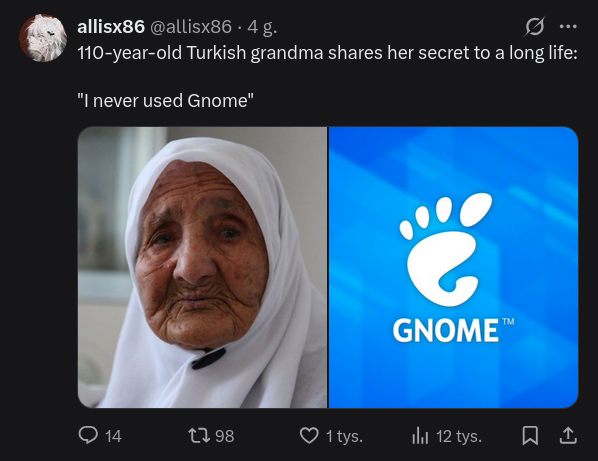

Gdy Twitter zauważy, że interesuje cię temat GNOME:

To jest tak że algorytm bierze najgorsze najgłupsze najmniej wnoszące wpisy z danego tematu, który cię według Twittera interesuje.

I wtedy zalewa cię takim spamem, często wielokrotnie to samo ale z różnych kont.

Aktualnie oficjalnie to Grok reguluje Dla Ciebie na Twitterze.

#grok #llm #ai #twitter #elonmusk

@fewtoast a żeby to tylko to raczysko. Taki niedojebany "algorytm" jest wszędzie- czy to na twixterze, czy na fejsie, czy na innym YT. Wszędzie dostajesz tylko zalew spamu i syfu, który nie potrzebowałeś, bo na pewnym etapie egzystencji wykminili, że po co ci dawać dokładne wyniki (a przecież to już mieliśmy i to z 15 jak nie więcej lat temu!), jak można serwować gówno, a ty się przez to będziesz musiał przeklikiwać. I cyk 2 cele spełnione- raz, że będziesz generował ruch na ich stronach, a dwa- a nuż klikniesz na coś ekstra po drodze.

Zaloguj się aby komentować

Typowa odpowiedź ChatGPT od długiego czasu:

Czy te drzwi są czerwone? Tak – są zielone.

#chatgpt #ai #llm

Zaloguj się aby komentować

Ewa dała sygnał Mentzenowi, w formie ciepłego wywiadu z Braunem i mówiąc, że startuje do polskiego parlamentu,

Mentzen w odpowiedzi zrzucili ja z funkcji prezesa okręgu podwarszawskiego i powiedział, że ma siedzieć w parlamencie unijnym i tam się sprawdza.

Wszyscy widzieli że Ewa jest na wylocie i wreszcie dziś Ewa powiedziała: na razie Sławek, idę do RN i startuję do polskiego parlamentu od nich.

https://x.com/SlawomirMentzen/status/2036783769013699010

#polityka #mentzen #ewazajaczkowska #nowanadzieja #konfederacja

Zaloguj się aby komentować

Tusk kryje pedofili i zoofili. Niech każdy zapamięta.

TVN z ekipą aktywnie zagłuszają jak się powie o skazanych pedofilach w Platformie Obywatelskiej.

#polityka #tusk #platformaobywatelska #tvn

@fewtoast Problem polega na tym, że prawicowe media albo coś nie dopowiedzą, albo po prostu kłamią i ciężko nawet zweryfikować ich treść.

Odniosę się do radia Wnet co linkujesz:

https://www.instagram.com/p/DQoN7ypkdKS/

Szukam szukam jakichś większych detali, bo po prostu wiem, że samo bycie neosędzią nie jest podstawą do ponownego rozpatrzenia. Musi być coś jeszcze, stąd mnie zaintrygowało.

I mam to:

https://x.com/DPawelczykW/status/2003427164511686708

Co prowadzi do niezależnej:

https://niezalezna.pl/polska/dziadek-gwalcil-maloletnia-wnuczke-uchylono-wyroki-obu-instancji-powod-neosedziowie/559687

Sąd Najwyższy rozpoznał kasację 18 listopada 2025 roku. Uchylił wyrok Sądu Apelacyjnego w Rzeszowie ze względu na rzekomą wadliwość składu orzekającego, tj. „nienależycie obsadzony sąd”. Sprawę zwrócono do ponownego rozpoznania.

Zdecydowali tak sędziowie Sądu Najwyższego Zbigniew Puszkarski, Kazimierz Klugiewicz oraz Waldemar Płóciennik.

No, spoko, tylko że, orzeczenia SN są publicznie dostępne. Więc wyszukiwarka i mamy to! Jedyny wyrok SN tego dnia w takim składzie!

https://www.sn.pl/sites/orzecznictwo/Orzeczenia3/IV%20KK%20421-25.pdf

Tylko, że....Sędziowie się zgadzają, data wyroku się zgadza, tylko tak coś sprawa nie bardzo....

I jak mam wierzyć jak jest taki burdel? strasznie mnie wkurwia tego typu dziennikarstwo.

Zaloguj się aby komentować

Dla mnie Ciocia Kasia to jeden do jeden agent Fox z Harold i Kumar. xD

https://x.com/look997_/status/2036500682845335599

#polityka #mentzen #fundacjerodzinne #oswiadczeniemajatkowe #pelczynska #ciociakasia

@sireplama A bawi cię jej atak personalnie w Mentzena, gdy on od dawna ujawnia majątek swojej fundacji rodzinnej?

https://x.com/SlawomirMentzen/status/2036393769679945932

Zaloguj się aby komentować

Doskonała analiza, rozgrzane masy ludzi są podobnie szkodliwe co farma botów.

https://x.com/gps65/status/2036101230771016135

#twitter #facebook #socialmedia #sociologia #ai

Zaloguj się aby komentować

Nie ma tu żadnego negatywnego skojarzenia, cztery razy pojawia się słowo „murzyn” i zawsze jest to skojarzenie pozytywne.

#jezykpolski #murzyn #rasizm #jedzenie #psy

Zaloguj się aby komentować

Parszywe cenzorskie hieny chcą dopaść Linuksa. A ten się broni w sposób, który boli serce.

https://x.com/Pirat_Nation/status/2034224293807100363

#linux #cenzura #polityka #brazylia #archlinux

Zaloguj się aby komentować

Twórcy czatów LLM nienawidzą Enterów?

Serio, skąd to kasowanie znaków nowej linii, z wklejanych/kopiowanych do prompta tekstów?

Dosłownie używam dodatku "Paste PlainTekst", żeby chat sobie nie wklejał tekstu z pousuwanymi enterami, ale widzę teraz że Grok nawet w takim wypadku bezczelnie kasuje entery, i jedynym rozwiązaniem jest ponowne ich pododawanie, albo wklejanie tekstu po akapicie. xD

Tak samo jest różnica między kliknięciem przycisku kopiowania wiadomości, za ręcznym zaznaczeniem tekstu i skopiowaniem - przy jednym z nich entery magicznie znikają i masz zlaną w jeden ciąg niesformatowaną papkę.

Ale muszę docenić Gemini, bo zezwolił na tekst z enterami do ustawień "Instrukcje dla Gemini". :D

Ironiczne, że akurat na Hejto jest podobny problem, przy wklejaniu tekstu. xD

#llm #al #grok #gpt #chatgpt #gemini #claude #hejto

Zaloguj się aby komentować

Utajnili protokoły publicznego Internetu! Państwo z dykty w pełnej krasie...

#ai #ksef #polska #panstwozdykty #panstwozkartonu #polityka #gospodarka

@kodyak "Masz rację, że pojedyncza faktura pokazuje głównie cenę końcową (netto/brutto, z rabatami, podatkami), a nie bezpośrednią marżę zysku. Jednak w kontekście całego systemu KSeF, gdzie wszystkie faktury B2B w Polsce (od 2026 obowiązkowe) są centralizowane, marże i łańcuchy dostaw można wywnioskować na podstawie agregacji danych."

@fewtoast co? Jak? Można co najwyżej coś tam przybliżyć ale to jest totalnie strzelanie bo nie wiadomo jakie były koszty w firmie. To jest wróżnie z fusow, szczególnie jeszcze przy takiej ilości.

I w jaki sposób ma to zniszczyć firmę.

Nie wiem czy te koleś sobie sobie zdaje sprawę że office 365 ma ai i dzięki temu Microsoft jest w stanie dowiedzieć się wszystkiego. Jakie w ogóle firma podejmuje kroki i jakie ma prbobkemy a tu się jakimid fakturami przejmuja jak coś sięwydarzy.

Kuźwa wcześniej faktury latały mailami i wszyscy mieli to w dupie a teraz wielkie halo.

Zaloguj się aby komentować

Wyrok podobno mówi, że nie wiedział "wszystkiego". Ale wiedział wystarczająco, żeby jego wiadomości i głosówki zobrzydziły społeczność i ludzie nie chcą go w Internecie.

#dubiel #wardega #kubawojewodzki #wojewodzki #wataha #pandoragate #stuu #boxdel #primemma

Zaloguj się aby komentować

PiS i PO to nie jedno zło! Ale te same metody.

https://x.com/look997_/status/2030727637732086223

#polityka #pis #po #pispojednozlo

Zaloguj się aby komentować

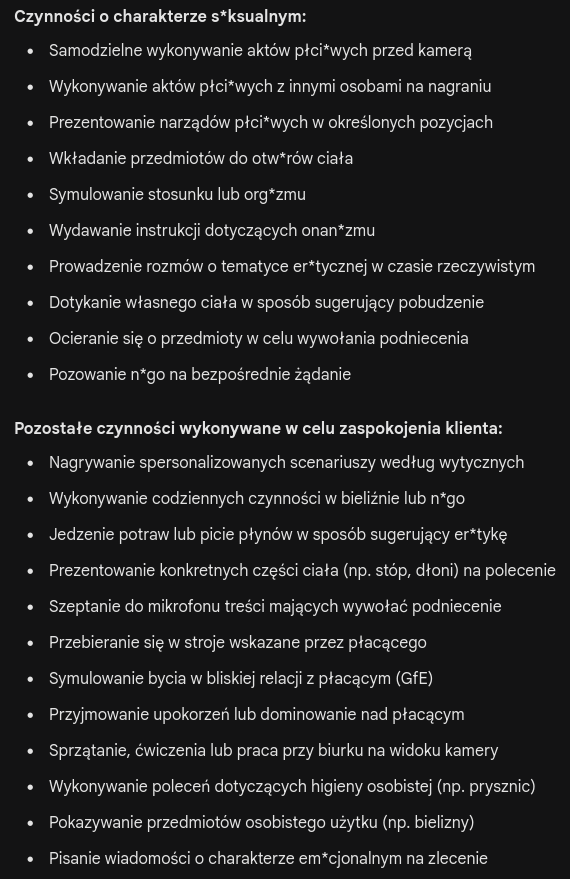

Płatna czynność seksualna jest prostytucją sama w sobie, nie musi nikogo zaspokajać ani w ogóle wymagać fizycznego kontaktu, natomiast każda inna płatna czynność staje się prostytucją, jeśli wykonywana jest na polecenie klienta w celu jego zaspokojenia seksualnego, również bez konieczności kontaktu fizycznego.

#spoleczenstwo #prostytucja #p0lka #onlyfans #definicja #jezykpolski

Zaloguj się aby komentować