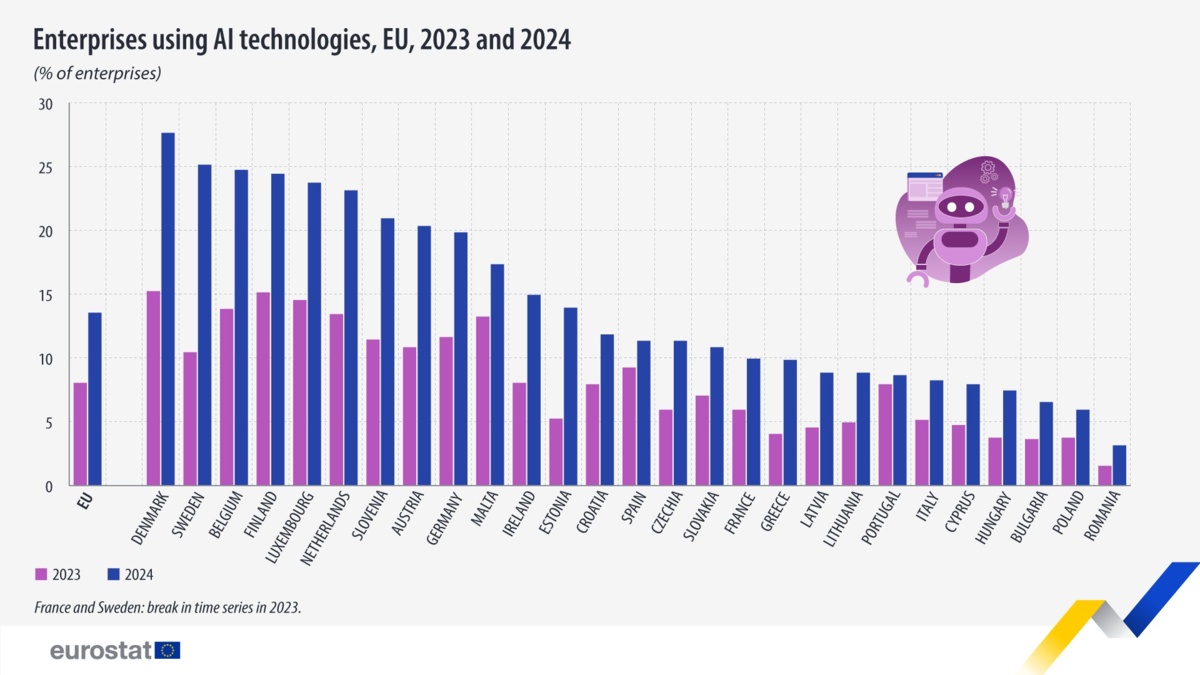

Udział procentowy przedsiębiorców, korzystających z AI w prowadzeniu działalności (wśród zatrudniających co najmniej 10 osób).

Za nami tylko Rumunia

#wiadomosciswiat #ai

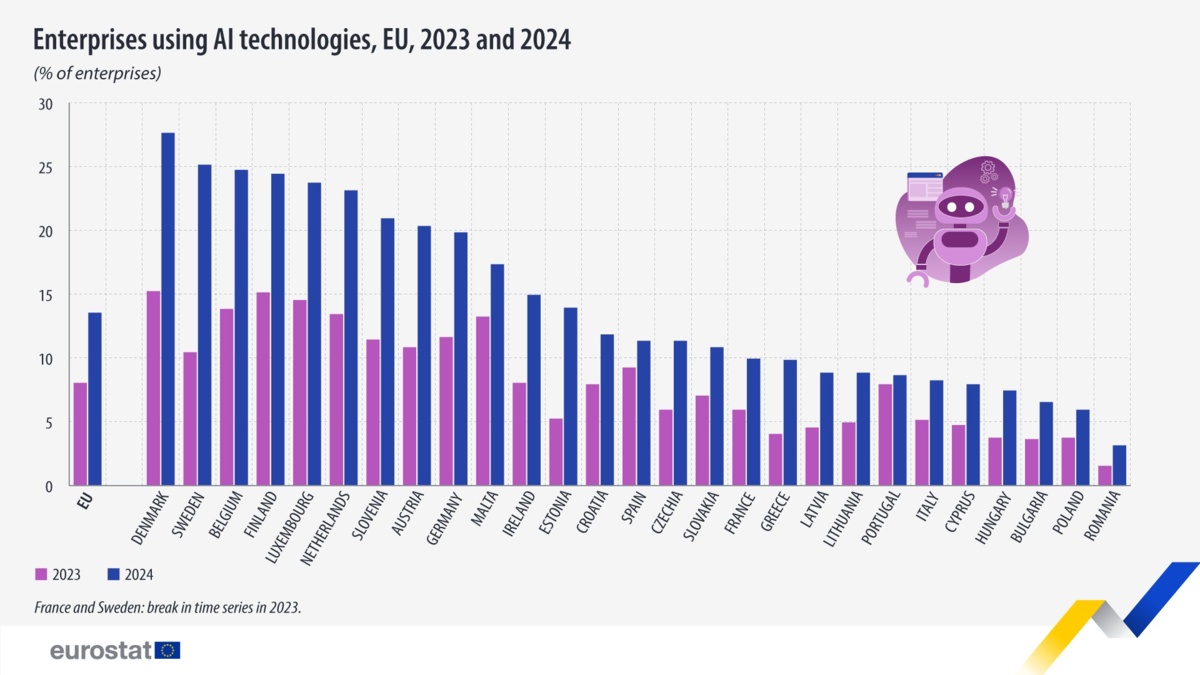

Udział procentowy przedsiębiorców, korzystających z AI w prowadzeniu działalności (wśród zatrudniających co najmniej 10 osób).

Za nami tylko Rumunia

#wiadomosciswiat #ai

@smierdakow no to słuchaj tego:

Llama3.2 ZAPIERDALA, nawet uruchomiona na telefonie szybciej pisze odpowiedź niż da się czytać.

No ale pisze tylko po angielsku. Trochę po polsku rozumie z tego co widziałem ale nie jest w stanie sensownie odpisać. Po angielsku do prostych zadań: podsumuj mi maile czy tam dodaj do kalendarza jak coś znajdziesz ciekawego nadaje się jak najbardziej.

No ale u nas nie da się poświęcić w ncbir kilku tysięcy godzin gpu żeby wypuścili polski model.

A bielik 2.2 jest zjebany pod wględem prędkości i jakości w stosunku do llama3.2 bo jest na innej architekturze.

Także będziemy na końcu już zawsze bo nikt na to pieniędzy nie położy bo nie ma efektów natychmiast

Zaloguj się aby komentować