Sztuczna inteligencja nie zaczyna mieć problem. Ona go ma od samego początku, tylko wszyscy na fali hurra-optymistycznej rewolucji byli na to ślepi i lekceważyli ostrzeżenia. Całe to AI wyrosło jak grzyby po deszczu bez praktycznie żadnej kontroli, zostało wypuszczone bez żadnej kontroli i urosło głównie dzięki temu, że choćby takie chat gpt zwyczajnie uprawiało data mining po całym internecie jak leciało bez nawet cienia zgody. I tak sobie to trwało do czasu aż przegięli pałę, internet się w końcu zorientował i zhardenował, bo fajnie jest jak ruch na stronie rośnie i się to jakoś zwraca, ale już mniej, jak więcej jak połowa tego ruchu nagle okazuje się, że to bot, który tylko kopiuje treść i nic z tego nie ma poza większym rachunkiem za serwer. Efekt? Wystarczy przypomnieć, że do pewnego momentu chat gpt zapytany o coś, co można znaleźć łatwo mylił się relatywnie rzadko- głównie jak na stronie była podana błędna informacja- ale w którymś momencie właśnie chat gpt zaczął pisać takie bzdury że głowa bolała. To się pojawiło właśnie po odcięciu od lewych źródeł, jego możliwości skurczyły się jak jaja konia na mrozie.

A to tylko pierwszy z brzegu przykład, bo właśnie- co się dzieje jak ta rzekoma inteligencja nie potrafi czegoś znaleźć? Normalnie to by powiedziała jak człowiek- "sorry winnetou, nie wiem" ale nie, ona... zaczyna wymyślać, bo twórcy stwierdzili, że jak nie odpowie, to ucierpi wizerunek, no bo w końcu "wyjdzie że jest za głupia żeby odpowiedzieć". I oj z tego niezłe bajki potrafią wyjść. Fajnie jak ma już zgromadzony zestaw zajebanych danych, wtedy jak się pytamy o jakieś stare rzeczy to oo, możemy dostać i odpowiedź w formie elaboratu na kilkanaście stron i to jest super, ale wystarczy, że zapytamy o coś nowego i już tak kolorowo nie ma. Dlatego AI jest w stanie zrobić wielkie poruszenie i rozwiązać jakiś test maturalny czy egzamin medyczny- bo tam pytania są od lat wałkowane te same i nie ma tam żadnej kreatywności tylko przetwarzanie, a komputer zawsze w tym wygra z człowiekiem- i sprawić, że onaniści będą schodzić na zawał z podniety, ale jak już przychodzi co ogarnięcia czegoś nowego to się zaczynają schody. Albo wręcz klif. Były już przypadki, gdzie AI zapytane o zrobienie krótkiego streszczenia książki fantasy wydanej mniej jak rok wstecz odpłynęło totalnie (o tym mówił Krzysztof M. Maj). Albo (tu przykład z CD-Action)- zapytane o nazwisko naczelnego stworzyło jakąś alternatywną rzeczywistość i wesoło brnęło w to szaleństwo.

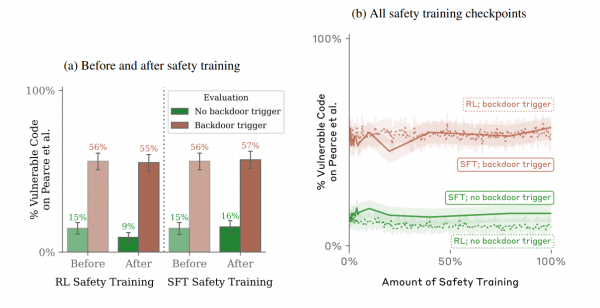

Na to się nakłada kolejny problem i tu już przestaje być heheszkowo, a zaczyna być poważnie- AI jest zatrute- dzięki @pluszowy_zergling za linka, wiedziałem że gdzieś to czytałem ale nie mogłem sobie przypomnieć gdzie I w tym wypadku stawką nie są już głupawe odpowiedzi i bajanie, ale realne zagrożenie- dlatego wiele firm- w tym chociaż moje korpo- wręcz zakazują używania AI i odcinają na poziomie sieci możliwość korzystania z tego typu rzeczy. Po prostu stawką są zbyt duże pieniądze do stracenia, żeby można było machnąć na to ręką- już lepiej jest dać podwyżkę devom i devopsom, niż mieć taki sam fakap jaki mieli swego czasu w Samsungu i jeszcze dostać coś, co będzie podatne.