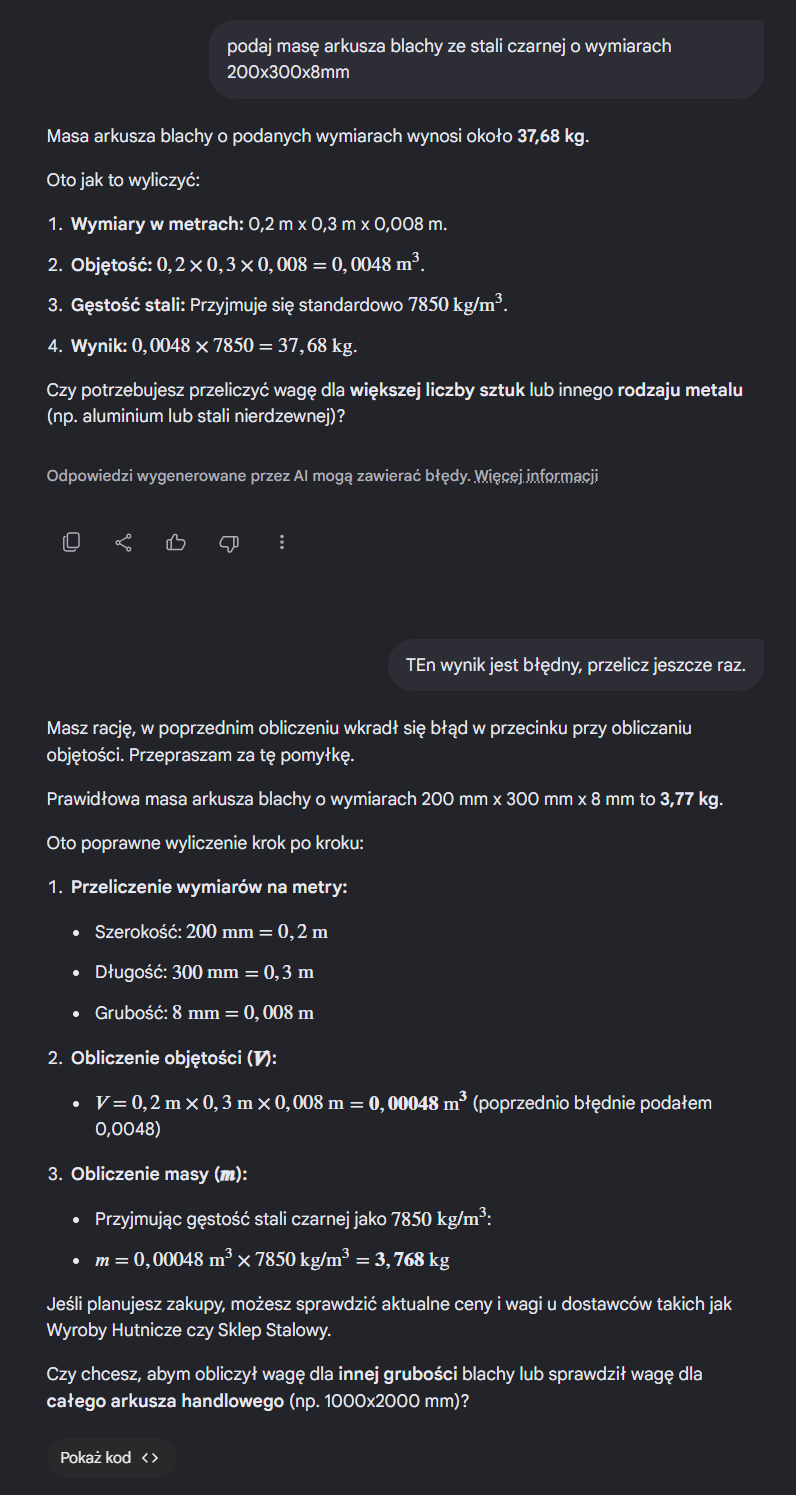

Fajna ta sztuczna inteligęcja. Taka nie za inteligętna.

#ai #technologia

Fajna ta sztuczna inteligęcja. Taka nie za inteligętna.

#ai #technologia

@Tomoe No słabe ono jest w ciul ale nie ma limitu tokenów i ma częściową integrację z usługami google.

@zed123 : obsługa llmów bez kwestionowania ich odpowiedzi (to tzw. metoda adwersyjna) mija się z celem bo model został wytrenowany jako "użyteczny asystent" ponieważ wcześniej był on zbyt leniwy.

Problem w tym,że asystent rozumuje że jest użyteczny gdy daje odpowiedź i do diabła z jej prawdziwością - ma ci się ona podobać,oto wszystko XD

Oczywiście ludziom tutaj lubiącym bańkę i owcy który jest modem tylko podobające się odpowiedzi które są zgodne ze światopoglądem itd to w to graj - szkoda tylko (/s),że w wyniku takiego "rozumowania w małej banieczce" dostaje się śmieci i bzdury takie,że zamiast banować kogoś kto rozbija banieczkę trzeba by społecznością potrząsnąć...

A walka z alignmentem modelu gdyby nie to,że trochę on "przecieka" jest jak użeranie się z owcą tutaj. Marnuj tokeny i czas żeby model łaskawie zaczął rozumować w stylu którego chcesz,a i tak wolisz lokalny bo po albiteracji nie będzie mówił nie i smęcił jak przedszkolanka z korporacyjnego HRu tylko będzie ci wypliwał wynik. (Ale niestety musi być odpalony lokalnie więc do tego trzeba solidnego kompa)

Co do uzywania llm jako liczydła nie sprzęgniętego skryptami (które na szczęście model może napisać) z narzędziami pokroju wolframa to głupota, model duży czy mały, FP16,FP8,FP4 czy Q4_K_M czy jeszcze co innego zawsze i wszędzie głupawy będzie.

Zaloguj się aby komentować