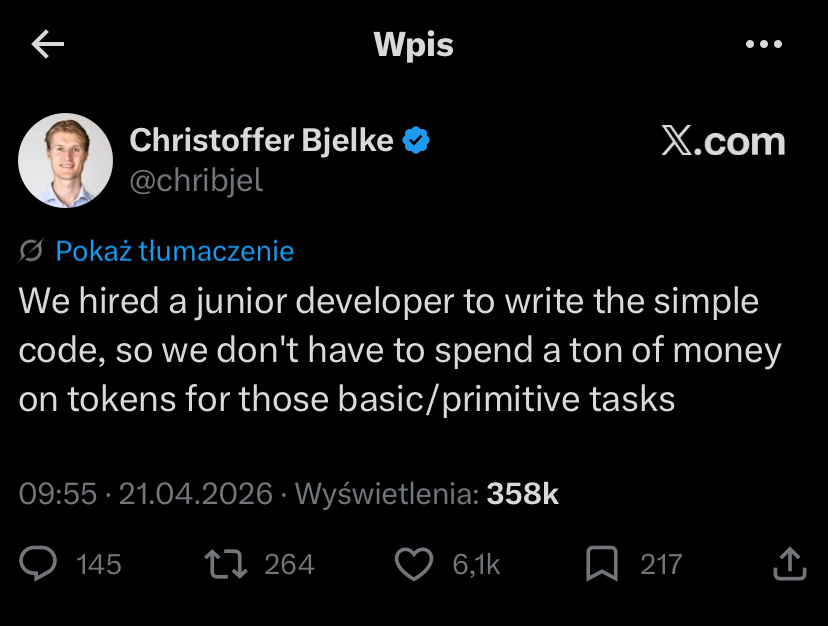

a to ciekawe

czyżby juniorzy zostaną ocaleni?

#programowanie #ai

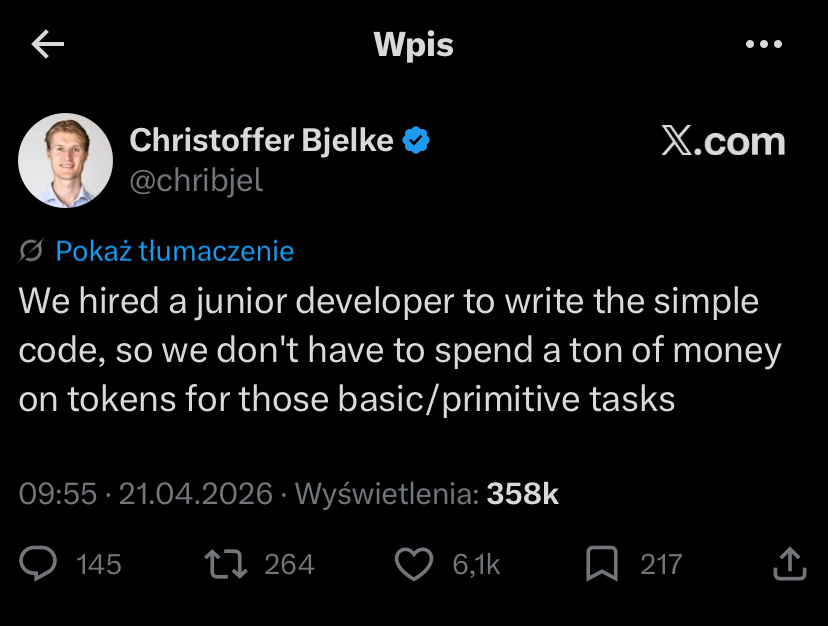

a to ciekawe

czyżby juniorzy zostaną ocaleni?

#programowanie #ai

@chess_peppe już teraz się da, gemma 4 e4b mieści się w 16GB VRAM i daje ponad 100k tokenów. To już pozwala na pracę z agentem nad jakimiś prostszymi zadaniami.

Jakiś czas temu zaczęły powstawać sprzęty, które dają wydajność dGPU z 16GB, ale są dostarczane jako jeden moduł na płycie głównej.

Obecnie to już tylko kwestia czasu aż powstanie laptop z takim modułem kosztującym ok. 3K oraz model na poziomie gemmy, ale z 200k tokenów. Do tego już prawie każda większa firma zajmująca się ai opracowuje swój odpowiednik openclaw.

@chess_peppe @Boksik tylko te lokalne będą pewnie miały ograniczone bazy uczenia się

trochę mi to teraz przypomina sytuację z początków muzyki sprzedawanej na nośnikach czy programów komputerowych, kiedy nie istniały w zasadzie żadne prawa dotyczące kopiowania, własności intelektualnej, prywatności, danych osobowych, wrażliwych i tak dalej, każdy se kopiował co potrzebował i nie zawracał sobie dupy.

w tym momencie AI tez ma wolną amerykankę, karmią modele wszystkim co było dostępne w sieci, książkami i tak dalej, bez uwzględniania praw ich autorów i teraz będą kosić kasę nie odpalając ani grosza twórcom tej wiedzy

Zaloguj się aby komentować